遥感大数据时代与智能信息提取

1

2018

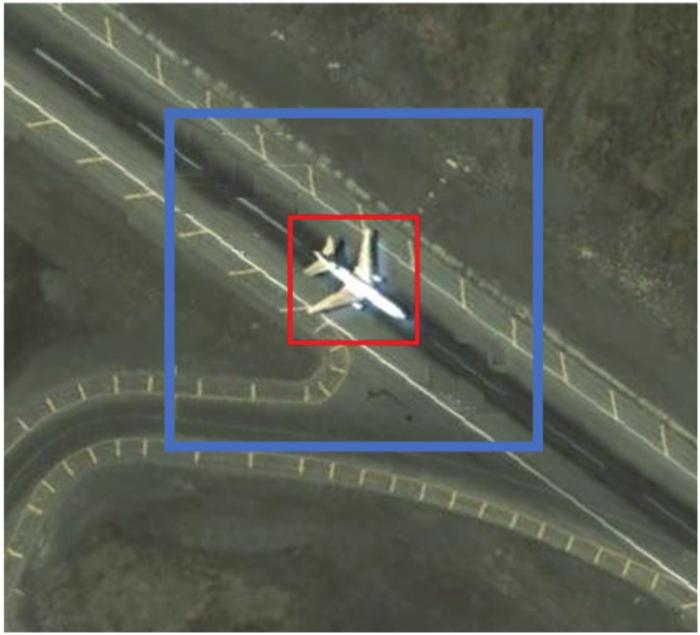

... 目标检测的定义来源于计算机视觉领域,即对图像中感兴趣的目标物体进行检测识别,并标记出其所在位置.在计算机视觉领域,目标检测的对象可以是现实世界里的任何对象,比如人、动物、汽车、建筑物等.在航空和卫星遥感图像中,目标检测对象大多是具有丰富自然属性和社会属性的地物[1],比如飞机、车辆、船舶、建筑等有清晰边界,可以明显区别于背景环境的单一目标[2];或者是多种单目标的组合体,比如机场、水泥厂、钢铁厂等.对地观测技术的快速发展,使得我们能够获取大量多时相、多维度、高分辨率的遥感图像.高分辨率遥感图像包含了丰富的地物细节特征,具有更加丰富的空间结构和拓扑关系.面对海量高分辨率遥感图像所蕴含的丰富地物信息,如何智能提取我们感兴趣的目标特征,一直是遥感图像目标检测研究中的热点. ...

遥感大数据时代与智能信息提取

1

2018

... 目标检测的定义来源于计算机视觉领域,即对图像中感兴趣的目标物体进行检测识别,并标记出其所在位置.在计算机视觉领域,目标检测的对象可以是现实世界里的任何对象,比如人、动物、汽车、建筑物等.在航空和卫星遥感图像中,目标检测对象大多是具有丰富自然属性和社会属性的地物[1],比如飞机、车辆、船舶、建筑等有清晰边界,可以明显区别于背景环境的单一目标[2];或者是多种单目标的组合体,比如机场、水泥厂、钢铁厂等.对地观测技术的快速发展,使得我们能够获取大量多时相、多维度、高分辨率的遥感图像.高分辨率遥感图像包含了丰富的地物细节特征,具有更加丰富的空间结构和拓扑关系.面对海量高分辨率遥感图像所蕴含的丰富地物信息,如何智能提取我们感兴趣的目标特征,一直是遥感图像目标检测研究中的热点. ...

A survey on object detection in optical remote sensing images

1

2016

... 目标检测的定义来源于计算机视觉领域,即对图像中感兴趣的目标物体进行检测识别,并标记出其所在位置.在计算机视觉领域,目标检测的对象可以是现实世界里的任何对象,比如人、动物、汽车、建筑物等.在航空和卫星遥感图像中,目标检测对象大多是具有丰富自然属性和社会属性的地物[1],比如飞机、车辆、船舶、建筑等有清晰边界,可以明显区别于背景环境的单一目标[2];或者是多种单目标的组合体,比如机场、水泥厂、钢铁厂等.对地观测技术的快速发展,使得我们能够获取大量多时相、多维度、高分辨率的遥感图像.高分辨率遥感图像包含了丰富的地物细节特征,具有更加丰富的空间结构和拓扑关系.面对海量高分辨率遥感图像所蕴含的丰富地物信息,如何智能提取我们感兴趣的目标特征,一直是遥感图像目标检测研究中的热点. ...

Rich feature hierarchies for accurate object detection and semantic Segmentatio

1

... 近年来,深度学习的快速发展,为遥感图像智能信息提取提供有利的技术支撑.基于深度学习的目标检测方法大多以卷积神经网络(Convolutional Neural Network,CNN)作为主干网络,因为卷积神经网络可以自动提取高层语义特征,相比于传统的人工提取特征,具有更强的特征表示能力;同时,卷积神经网络主动学习特征的能力,在大数据时代具有突出优势.卷积神经网络的快速发展,解决了计算机视觉领域的很多难题,在图像目标检测领域取得了巨大成功[3-13].然而,深度学习模型很大程度上依赖于庞大的标记数据,这需要大量的人工成本和时间成本.由于遥感图像目标具有多尺度、多旋转角度等特点,且易受光照条件、遮挡、复杂背景等影响,与自然图像目标特征存在明显差异,这使得以卷积神经网络为核心的深度学习模型直接应用到遥感图像目标检测存在一定困难[14]. ...

R-FCN: Object detection via region-based fully convolutional networks

0

SSD:single shot multibox detector

0

2016

You only look once:unified,real-time object detection

0

2016

DSSD: deconvolutional single shot detector

0

Feature pyramid networks for object detection

0

YOLO9000: Better, Faster, Stronger

0

2017

Faster R-CNN: Towards feal-time object detection with region proposal networks

0

2017

Focal loss for dense object detection

0

YOLOv3: An incremental improvement

1

... 近年来,深度学习的快速发展,为遥感图像智能信息提取提供有利的技术支撑.基于深度学习的目标检测方法大多以卷积神经网络(Convolutional Neural Network,CNN)作为主干网络,因为卷积神经网络可以自动提取高层语义特征,相比于传统的人工提取特征,具有更强的特征表示能力;同时,卷积神经网络主动学习特征的能力,在大数据时代具有突出优势.卷积神经网络的快速发展,解决了计算机视觉领域的很多难题,在图像目标检测领域取得了巨大成功[3-13].然而,深度学习模型很大程度上依赖于庞大的标记数据,这需要大量的人工成本和时间成本.由于遥感图像目标具有多尺度、多旋转角度等特点,且易受光照条件、遮挡、复杂背景等影响,与自然图像目标特征存在明显差异,这使得以卷积神经网络为核心的深度学习模型直接应用到遥感图像目标检测存在一定困难[14]. ...

Object detection in optical remote sensing images: A survey and a new benchmark

2

2020

... 近年来,深度学习的快速发展,为遥感图像智能信息提取提供有利的技术支撑.基于深度学习的目标检测方法大多以卷积神经网络(Convolutional Neural Network,CNN)作为主干网络,因为卷积神经网络可以自动提取高层语义特征,相比于传统的人工提取特征,具有更强的特征表示能力;同时,卷积神经网络主动学习特征的能力,在大数据时代具有突出优势.卷积神经网络的快速发展,解决了计算机视觉领域的很多难题,在图像目标检测领域取得了巨大成功[3-13].然而,深度学习模型很大程度上依赖于庞大的标记数据,这需要大量的人工成本和时间成本.由于遥感图像目标具有多尺度、多旋转角度等特点,且易受光照条件、遮挡、复杂背景等影响,与自然图像目标特征存在明显差异,这使得以卷积神经网络为核心的深度学习模型直接应用到遥感图像目标检测存在一定困难[14]. ...

... DIOR[14]是西北工业大学韩军伟课题组提出的主要用于光学遥感图像目标检测的数据集,包含20类目标:飞机、机场、棒球场、篮球场、立交桥、桥梁、烟囱、大坝、高速公路服务区、高速公路收费站、高尔夫球场、地面田径场、港口、船舶、体育场、油罐、网球场、火车站、车辆和风车.该数据集共有23 463张遥感图像和192 472个实例,训练集,验证集和测试集占比为1∶1∶2,图像尺寸为800×800,空间分辨率为0.5~30 m.该数据集使用了12种检测器对其进行测试,其中使用基于ResNet-101的PANet方法和RetinaNet检测结果最好,准确度高达66.1%.DIOR数据集在类别和数量上都是现有遥感图像目标检测数据集中最庞大的,其遥感卫星图像是在不同天气、季节和成像条件下采集自多个国家,拥有不同空间分辨率和不同尺度场景,且选择的样本具有类间相似性和类内多样性,适用于地球观测和评估各种深度学习方法. ...

A novel multi-model decision fusion network for object detection in remote sensing images

1

2019

... 深度学习的核心是深度神经网络,其依靠庞大的参数和复杂的结构通过自我更新来学习输入和输出的映射关系.其中卷积神经网络因其强大的特征学习和图像理解能力,成为目标检测特征提取的核心结构.除了常用的卷积神经网络,循环神经网络(Recurrent Neural Network,RNN),自编码器(AutoEncoder, AE),生成对抗网络(Generative Adversarial Network,GAN)等在目标检测中均有重要的应用.RNN可以将上一时刻隐藏层的信息输入至下一时刻,从而有效整合上下文信息.RNN一个典型的结构为门控制循环神经元(Gated Recurrent Units,GRU),通过设计门结构来抑制信息的流失.在CNN结构中加入GRU结构[15],可以抑制无用信息,提取更丰富的有效信息,以增强CNN的特征学习能力.AE是一种无监督学习方法,通过编码和解码操作进行数据降维或特征学习.AE的变形有堆叠自动编码(Stacked AtuoEncoder,SAE)、变分自动编码(Variational AtuoEncoder,VAE)等,这些在高维度数据处理中有重要的应用[16-17].GAN也是一种无监督学习技术,通过一个生成器和一个判别器相互对抗,生成和真实图像相近的结果.在遥感图像目标检测中,GAN可以用来生成更多的训练样本[18]. ...

Learning compact and discriminative stacked autoencoder for hyperspectral image classification

4

2019

... 深度学习的核心是深度神经网络,其依靠庞大的参数和复杂的结构通过自我更新来学习输入和输出的映射关系.其中卷积神经网络因其强大的特征学习和图像理解能力,成为目标检测特征提取的核心结构.除了常用的卷积神经网络,循环神经网络(Recurrent Neural Network,RNN),自编码器(AutoEncoder, AE),生成对抗网络(Generative Adversarial Network,GAN)等在目标检测中均有重要的应用.RNN可以将上一时刻隐藏层的信息输入至下一时刻,从而有效整合上下文信息.RNN一个典型的结构为门控制循环神经元(Gated Recurrent Units,GRU),通过设计门结构来抑制信息的流失.在CNN结构中加入GRU结构[15],可以抑制无用信息,提取更丰富的有效信息,以增强CNN的特征学习能力.AE是一种无监督学习方法,通过编码和解码操作进行数据降维或特征学习.AE的变形有堆叠自动编码(Stacked AtuoEncoder,SAE)、变分自动编码(Variational AtuoEncoder,VAE)等,这些在高维度数据处理中有重要的应用[16-17].GAN也是一种无监督学习技术,通过一个生成器和一个判别器相互对抗,生成和真实图像相近的结果.在遥感图像目标检测中,GAN可以用来生成更多的训练样本[18]. ...

... The object detection methods of hyperspectral images

Table 5| 文献 | 方法 | 特点 |

|---|

| Li等[51],2017 | CNN | 从训练样本中选择像素对来训练CNN,用训练好的CNN衡量测试像素和周围环境的相似度,并对这些相似度值进行平均作为最终测试输出 |

| Cheng等[52],2018 | CNN | 使用CNN来提取高光谱图像深层特征,同时提出了一种基于度量学习的框架来学习判别频谱空间特征,最终在SVM中嵌入一个度量学习正则化项以实现高光谱图像分类 |

| Zhou等[16],2019 | 堆叠自动编码器 | 提出了一个高光谱图像分类框架CDSAE,利用局部Fisher判别正则化和多样性正则化来训练模型 |

| Xie等[17],2020 | 光谱正则化无监督网络 | 基于AE和VAE构建了光谱正则化无监督网络,证明了其在目标检测上表现更好 |

高光谱图像光谱分辨率高,光谱信息丰富,每个像素都呈现连续的光谱曲线,这些光谱信息可以反映地物之间的细微差异,像素可以表达目标的物理属性.相比于可见光、SAR等图像,信息丰富的高光谱图像在遥感图像目标检测中具有突出优势.深度学习模型具备较强的特征学习能力,可以高效地用于海量数据的处理.用深度学习模型充分挖掘高光谱图像的光谱信息和空间信息,可以实现对高光谱图像目标的精准检测.Li等[51]通过利用同类目标像素对之间的相似度以及不同类目标像素之间的差异训练CNN,以挖掘高光谱图像像素信息来进行类别检测.Cheng等[52]利用CNN提取高光谱图像空间特征,并在SVM中嵌入一个度量学习正则化项以学习高光谱图像的光谱和空间特征.Zhou等[16]在堆叠自动编码(Stacked Autoencoder, SAE)的每个隐藏层中加入局部Fisher判别正则化项和多样性正则化项,用于学习低维特征表达,之后用这两种正则化来联合训练特征提取器和分类器,以实现高光谱图像分类.鉴于样本有限,Xie等[17]研究发现无监督学习在高光谱图像目标检测上较监督学习表现更好,相比于自动编码(Auto Encoder, AE)和变分编码(Variational Auto Encoder, VAE)更具优势. ...

... 高光谱图像光谱分辨率高,光谱信息丰富,每个像素都呈现连续的光谱曲线,这些光谱信息可以反映地物之间的细微差异,像素可以表达目标的物理属性.相比于可见光、SAR等图像,信息丰富的高光谱图像在遥感图像目标检测中具有突出优势.深度学习模型具备较强的特征学习能力,可以高效地用于海量数据的处理.用深度学习模型充分挖掘高光谱图像的光谱信息和空间信息,可以实现对高光谱图像目标的精准检测.Li等[51]通过利用同类目标像素对之间的相似度以及不同类目标像素之间的差异训练CNN,以挖掘高光谱图像像素信息来进行类别检测.Cheng等[52]利用CNN提取高光谱图像空间特征,并在SVM中嵌入一个度量学习正则化项以学习高光谱图像的光谱和空间特征.Zhou等[16]在堆叠自动编码(Stacked Autoencoder, SAE)的每个隐藏层中加入局部Fisher判别正则化项和多样性正则化项,用于学习低维特征表达,之后用这两种正则化来联合训练特征提取器和分类器,以实现高光谱图像分类.鉴于样本有限,Xie等[17]研究发现无监督学习在高光谱图像目标检测上较监督学习表现更好,相比于自动编码(Auto Encoder, AE)和变分编码(Variational Auto Encoder, VAE)更具优势. ...

... 高光谱图像具有庞大而丰富的光谱信息,然而,很多情况下高光谱图像中同类地物光谱差别大,不同类之间具有光谱相似性[16].此外,高光谱图像的波段具有强相关性,易造成大量的信息冗余.高维度特征和高冗余信息都对高光谱图像目标检测模型提出更高要求.深度学习可以为高光谱图像信息提取提供强大的技术支撑,但由于神经网络参数众多以及高光谱图像标记样本成本高等问题,基于深度学习的高光谱图像目标检测仍面临巨大挑战.因此,基于深度学习的高光谱图像目标检测方法还需进一步深入研究. ...

SRUN: spectral regularized unsupervised networks for hyperspectral target detection

3

2020

... 深度学习的核心是深度神经网络,其依靠庞大的参数和复杂的结构通过自我更新来学习输入和输出的映射关系.其中卷积神经网络因其强大的特征学习和图像理解能力,成为目标检测特征提取的核心结构.除了常用的卷积神经网络,循环神经网络(Recurrent Neural Network,RNN),自编码器(AutoEncoder, AE),生成对抗网络(Generative Adversarial Network,GAN)等在目标检测中均有重要的应用.RNN可以将上一时刻隐藏层的信息输入至下一时刻,从而有效整合上下文信息.RNN一个典型的结构为门控制循环神经元(Gated Recurrent Units,GRU),通过设计门结构来抑制信息的流失.在CNN结构中加入GRU结构[15],可以抑制无用信息,提取更丰富的有效信息,以增强CNN的特征学习能力.AE是一种无监督学习方法,通过编码和解码操作进行数据降维或特征学习.AE的变形有堆叠自动编码(Stacked AtuoEncoder,SAE)、变分自动编码(Variational AtuoEncoder,VAE)等,这些在高维度数据处理中有重要的应用[16-17].GAN也是一种无监督学习技术,通过一个生成器和一个判别器相互对抗,生成和真实图像相近的结果.在遥感图像目标检测中,GAN可以用来生成更多的训练样本[18]. ...

... The object detection methods of hyperspectral images

Table 5| 文献 | 方法 | 特点 |

|---|

| Li等[51],2017 | CNN | 从训练样本中选择像素对来训练CNN,用训练好的CNN衡量测试像素和周围环境的相似度,并对这些相似度值进行平均作为最终测试输出 |

| Cheng等[52],2018 | CNN | 使用CNN来提取高光谱图像深层特征,同时提出了一种基于度量学习的框架来学习判别频谱空间特征,最终在SVM中嵌入一个度量学习正则化项以实现高光谱图像分类 |

| Zhou等[16],2019 | 堆叠自动编码器 | 提出了一个高光谱图像分类框架CDSAE,利用局部Fisher判别正则化和多样性正则化来训练模型 |

| Xie等[17],2020 | 光谱正则化无监督网络 | 基于AE和VAE构建了光谱正则化无监督网络,证明了其在目标检测上表现更好 |

高光谱图像光谱分辨率高,光谱信息丰富,每个像素都呈现连续的光谱曲线,这些光谱信息可以反映地物之间的细微差异,像素可以表达目标的物理属性.相比于可见光、SAR等图像,信息丰富的高光谱图像在遥感图像目标检测中具有突出优势.深度学习模型具备较强的特征学习能力,可以高效地用于海量数据的处理.用深度学习模型充分挖掘高光谱图像的光谱信息和空间信息,可以实现对高光谱图像目标的精准检测.Li等[51]通过利用同类目标像素对之间的相似度以及不同类目标像素之间的差异训练CNN,以挖掘高光谱图像像素信息来进行类别检测.Cheng等[52]利用CNN提取高光谱图像空间特征,并在SVM中嵌入一个度量学习正则化项以学习高光谱图像的光谱和空间特征.Zhou等[16]在堆叠自动编码(Stacked Autoencoder, SAE)的每个隐藏层中加入局部Fisher判别正则化项和多样性正则化项,用于学习低维特征表达,之后用这两种正则化来联合训练特征提取器和分类器,以实现高光谱图像分类.鉴于样本有限,Xie等[17]研究发现无监督学习在高光谱图像目标检测上较监督学习表现更好,相比于自动编码(Auto Encoder, AE)和变分编码(Variational Auto Encoder, VAE)更具优势. ...

... 高光谱图像光谱分辨率高,光谱信息丰富,每个像素都呈现连续的光谱曲线,这些光谱信息可以反映地物之间的细微差异,像素可以表达目标的物理属性.相比于可见光、SAR等图像,信息丰富的高光谱图像在遥感图像目标检测中具有突出优势.深度学习模型具备较强的特征学习能力,可以高效地用于海量数据的处理.用深度学习模型充分挖掘高光谱图像的光谱信息和空间信息,可以实现对高光谱图像目标的精准检测.Li等[51]通过利用同类目标像素对之间的相似度以及不同类目标像素之间的差异训练CNN,以挖掘高光谱图像像素信息来进行类别检测.Cheng等[52]利用CNN提取高光谱图像空间特征,并在SVM中嵌入一个度量学习正则化项以学习高光谱图像的光谱和空间特征.Zhou等[16]在堆叠自动编码(Stacked Autoencoder, SAE)的每个隐藏层中加入局部Fisher判别正则化项和多样性正则化项,用于学习低维特征表达,之后用这两种正则化来联合训练特征提取器和分类器,以实现高光谱图像分类.鉴于样本有限,Xie等[17]研究发现无监督学习在高光谱图像目标检测上较监督学习表现更好,相比于自动编码(Auto Encoder, AE)和变分编码(Variational Auto Encoder, VAE)更具优势. ...

Diverse sample generation with multi-branch conditional generative adversarial network for remote sensing objects detection

3

2020

... 深度学习的核心是深度神经网络,其依靠庞大的参数和复杂的结构通过自我更新来学习输入和输出的映射关系.其中卷积神经网络因其强大的特征学习和图像理解能力,成为目标检测特征提取的核心结构.除了常用的卷积神经网络,循环神经网络(Recurrent Neural Network,RNN),自编码器(AutoEncoder, AE),生成对抗网络(Generative Adversarial Network,GAN)等在目标检测中均有重要的应用.RNN可以将上一时刻隐藏层的信息输入至下一时刻,从而有效整合上下文信息.RNN一个典型的结构为门控制循环神经元(Gated Recurrent Units,GRU),通过设计门结构来抑制信息的流失.在CNN结构中加入GRU结构[15],可以抑制无用信息,提取更丰富的有效信息,以增强CNN的特征学习能力.AE是一种无监督学习方法,通过编码和解码操作进行数据降维或特征学习.AE的变形有堆叠自动编码(Stacked AtuoEncoder,SAE)、变分自动编码(Variational AtuoEncoder,VAE)等,这些在高维度数据处理中有重要的应用[16-17].GAN也是一种无监督学习技术,通过一个生成器和一个判别器相互对抗,生成和真实图像相近的结果.在遥感图像目标检测中,GAN可以用来生成更多的训练样本[18]. ...

... 数据增广也是解决样本量少的一种通用方法,通过几何变换、色彩抖动、高斯噪声等方法扩充训练数据集,丰富数据多样性,以增强模型的泛化能力.也有研究者提出使用生成对抗机(Generative Adversarial Network,GAN)的方法来生成多样的训练样本,用于目标检测[18].但是,该方法没有从根本上改善模型对多样化目标的处理能力. ...

... The object detection methods of limited samples

Table 4| 文献 | 方法 | 特点 |

|---|

| Zhou等[45],2016;Zhong等[46],2018;Dong等[47],2019 | 迁移学习 | 将在大规模自然图像数据集上的训练模型用于遥感图像目标检测,并进行训练微调 |

| Zhu等[18],2020 | 数据增广 | 用生成对抗网络GAN产生新的数据集来训练模型 |

| Han等[48],2015 | 弱监督学习 | 提出了一种基于贝叶斯原理的弱监督学习框架,对弱标注的样本进行训练,通过迭代更新正样本集标签 |

| Zhang等[49],2015 | 弱监督学习 | 通过基于显著性自适应分割和负挖掘得到初始训练样本,然后通过迭代训练逐步细化训练样本 |

| Zhou等[45],2016 | 弱监督学习 | 提出了一种负样本自举的弱监督目标检测框架,基于显著性的自适应分割方法收集初始正样本,通过生成最可能的正样本和视觉上与正样本最相关的负样本来初始化训练样本,然后使用这些样本迭代训练检测器 |

| Zhang等[50],2016 | 弱监督学习 | 首先初始化训练样本,其次通过挖掘的负样本、标记样本以及辅助数据进行迭代训练,更新训练样本 |

2.1.5 多波段遥感图像目标检测目前大多数遥感图像目标检测任务主要针对光学遥感图像,一般包含RGB 3个波段.遥感数据的不同波段包含了丰富的地物信息,不同地物对不同的光谱波长具有不同的吸收率和反射率,以此可以对地物进行有效区分.多波段图像在地物识别上较RGB图像更具优势,因此,如何利用遥感图像多波段信息进行特征学习,也是遥感图像目标检测的研究重点.不同文献的高光谱目标检测方法对比见表5. ...

BMF-CNN: An object detection method based on multi-scale feature fusion in VHR remote sensing images

2

2020

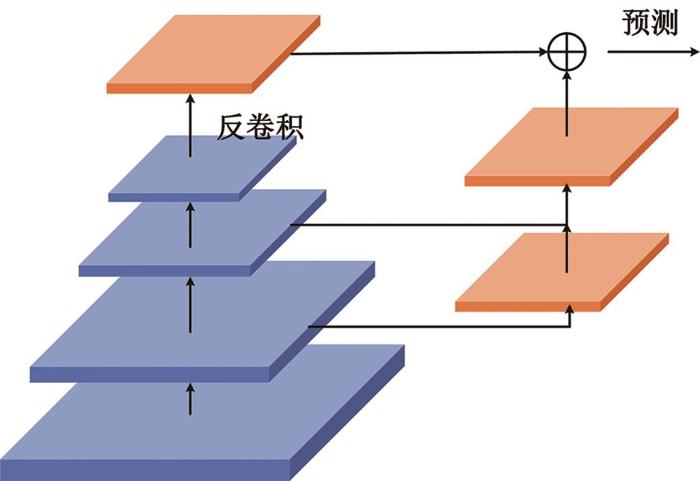

... 自下而上的特征融合结构如图1所示,融合低层特征和高层特征的反卷积输出,获得更丰富的特征表达.Dong等[19]和Zhu等[20]都构建了自下而上的网络,不同于特征金字塔整合主干网络的所有特征层,而是融合较低层和高层语义信息,有效提高了小目标的表征能力. ...

... The object detection methods of scale invariance

Table 1| 文献 | 方法 | 特点 |

|---|

| Zhu等[20],2019 | 自下而上融合 | 受文献[27]启发,提取不同卷积层(conv3,conv4,conv5)候选区域对应的特征向量,经过兴趣特征池化层(ROI Pooling)、L2归一化,以促进多尺度特征融合 |

| Dong等[19],2020 | 自下而上融合 | 将进行膨胀扩张的卷积神经网络分支(conv4)和顶层卷积层的反卷积输出(conv5)融合,以有效利用高层语义信息 |

| Yang等[21],2018 | 自上而下融合 | 在ResNet网络基础上构建了5层特征金字塔 |

| Zhu等[22],2019 | 自上而下融合 | 在密集网络DenseNet上构建了3层特征金字塔网络以获取小目标特征 |

| Zhuang等[23],2019 | 自上而下融合 | 在Darknet-53网络基础上构建了3层特征金字塔 |

| Zhang等[24],2019 | 自上而下融合 | 构建了一种多尺度区域建议网络和多尺度目标检测网络,同时,提出了多尺度训练策略(使用基于斑块的多尺度训练数据以及使用多尺寸的图像进行训练)并进行消融实验 |

| Qiu等[25],2019 | 自上而下融合 | 在特征金字塔基础上加入一个门融合(gate fusion)模块,使得模型可以选择性地融合CNN不同尺度特征 |

| Cheng等[26],2020 | 自上而下以及跨尺度融合 | 在构建FPN的基础上,提出了一种跨尺度特征融合策略,对每个特征尺度进行特征融合和特征增强 |

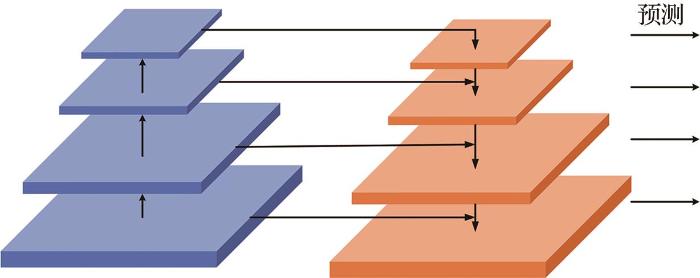

2.1.2 实现旋转不变性的旋转感兴趣区对任意旋转角度的目标具备识别能力,以实现旋转不变性一直是目标检测领域的重要课题.遥感图像目标,如飞机、船舶等,目标比较狭长,一般呈现多种旋转角度,这就需要模型对任意旋转角度的目标具备较强的识别能力.当旋转目标之间排列紧密的情况下,仅使用最小矩形包围框标记样本,会增加无用的背景信息影响模型的判断,从而无法准确检测每个目标的位置. ...

Effective airplane detection in remote sensing images based on multilayer feature fusion and improved nonmaximal suppression algorithm

3

2019

... 自下而上的特征融合结构如图1所示,融合低层特征和高层特征的反卷积输出,获得更丰富的特征表达.Dong等[19]和Zhu等[20]都构建了自下而上的网络,不同于特征金字塔整合主干网络的所有特征层,而是融合较低层和高层语义信息,有效提高了小目标的表征能力. ...

... The object detection methods of scale invariance

Table 1| 文献 | 方法 | 特点 |

|---|

| Zhu等[20],2019 | 自下而上融合 | 受文献[27]启发,提取不同卷积层(conv3,conv4,conv5)候选区域对应的特征向量,经过兴趣特征池化层(ROI Pooling)、L2归一化,以促进多尺度特征融合 |

| Dong等[19],2020 | 自下而上融合 | 将进行膨胀扩张的卷积神经网络分支(conv4)和顶层卷积层的反卷积输出(conv5)融合,以有效利用高层语义信息 |

| Yang等[21],2018 | 自上而下融合 | 在ResNet网络基础上构建了5层特征金字塔 |

| Zhu等[22],2019 | 自上而下融合 | 在密集网络DenseNet上构建了3层特征金字塔网络以获取小目标特征 |

| Zhuang等[23],2019 | 自上而下融合 | 在Darknet-53网络基础上构建了3层特征金字塔 |

| Zhang等[24],2019 | 自上而下融合 | 构建了一种多尺度区域建议网络和多尺度目标检测网络,同时,提出了多尺度训练策略(使用基于斑块的多尺度训练数据以及使用多尺寸的图像进行训练)并进行消融实验 |

| Qiu等[25],2019 | 自上而下融合 | 在特征金字塔基础上加入一个门融合(gate fusion)模块,使得模型可以选择性地融合CNN不同尺度特征 |

| Cheng等[26],2020 | 自上而下以及跨尺度融合 | 在构建FPN的基础上,提出了一种跨尺度特征融合策略,对每个特征尺度进行特征融合和特征增强 |

2.1.2 实现旋转不变性的旋转感兴趣区对任意旋转角度的目标具备识别能力,以实现旋转不变性一直是目标检测领域的重要课题.遥感图像目标,如飞机、船舶等,目标比较狭长,一般呈现多种旋转角度,这就需要模型对任意旋转角度的目标具备较强的识别能力.当旋转目标之间排列紧密的情况下,仅使用最小矩形包围框标记样本,会增加无用的背景信息影响模型的判断,从而无法准确检测每个目标的位置. ...

... 针对飞机目标检测中的弱小目标表征能力不足等问题,现有研究大多使用多尺度特征融合的方法[20,62-63],以提高小目标的检测能力.大尺度遥感图像在分割预处理时,容易丢失较小的飞机目标,Chen等[64]提出了一种端到端的飞机目标检测算法,在输入层前和输出层后分别加入MultiBlock层和MapBlock层,将输入图像调整尺寸为均匀大小,最后将输出的检测结果图映射与输入图尺寸一致.此外,大尺度下小目标特征不突出,容易与非目标类别混淆,通过在卷积网络中加入注意力模块[43]或者引入空洞残差进行多尺度特征融合[65],捕捉目标的上下文信息,从而提高模型的特征表达能力. ...

Position detection and direction prediction for arbitrary-oriented ships via multitask rotation region convolutional neural network

6

2018

... 自上而下的特征融合如图2所示,类似特征金字塔网络(Feature Pyramid Network,FPN)结构,自上而下将不同尺度的特征层分别与上一级高层特征上采样的结果融合,最终构成多级特征金字塔,每一层对应不同尺度的目标特征.Yang等[21-24]基于卷积神经网络构建特征金字塔进行特征融合,提高了小目标检测精度.在特征金字塔基础上,Qiu等[25]在每一层加入一个gate fusion模块,通过控制不同尺度特征信息流,来选择有效特征以抑制不相关特征.Cheng等[26]在FPN的基础上,提出了一种新的特征融合策略,通过融合跨尺度特征信息,以实现多尺度目标检测. ...

... The object detection methods of scale invariance

Table 1| 文献 | 方法 | 特点 |

|---|

| Zhu等[20],2019 | 自下而上融合 | 受文献[27]启发,提取不同卷积层(conv3,conv4,conv5)候选区域对应的特征向量,经过兴趣特征池化层(ROI Pooling)、L2归一化,以促进多尺度特征融合 |

| Dong等[19],2020 | 自下而上融合 | 将进行膨胀扩张的卷积神经网络分支(conv4)和顶层卷积层的反卷积输出(conv5)融合,以有效利用高层语义信息 |

| Yang等[21],2018 | 自上而下融合 | 在ResNet网络基础上构建了5层特征金字塔 |

| Zhu等[22],2019 | 自上而下融合 | 在密集网络DenseNet上构建了3层特征金字塔网络以获取小目标特征 |

| Zhuang等[23],2019 | 自上而下融合 | 在Darknet-53网络基础上构建了3层特征金字塔 |

| Zhang等[24],2019 | 自上而下融合 | 构建了一种多尺度区域建议网络和多尺度目标检测网络,同时,提出了多尺度训练策略(使用基于斑块的多尺度训练数据以及使用多尺寸的图像进行训练)并进行消融实验 |

| Qiu等[25],2019 | 自上而下融合 | 在特征金字塔基础上加入一个门融合(gate fusion)模块,使得模型可以选择性地融合CNN不同尺度特征 |

| Cheng等[26],2020 | 自上而下以及跨尺度融合 | 在构建FPN的基础上,提出了一种跨尺度特征融合策略,对每个特征尺度进行特征融合和特征增强 |

2.1.2 实现旋转不变性的旋转感兴趣区对任意旋转角度的目标具备识别能力,以实现旋转不变性一直是目标检测领域的重要课题.遥感图像目标,如飞机、船舶等,目标比较狭长,一般呈现多种旋转角度,这就需要模型对任意旋转角度的目标具备较强的识别能力.当旋转目标之间排列紧密的情况下,仅使用最小矩形包围框标记样本,会增加无用的背景信息影响模型的判断,从而无法准确检测每个目标的位置. ...

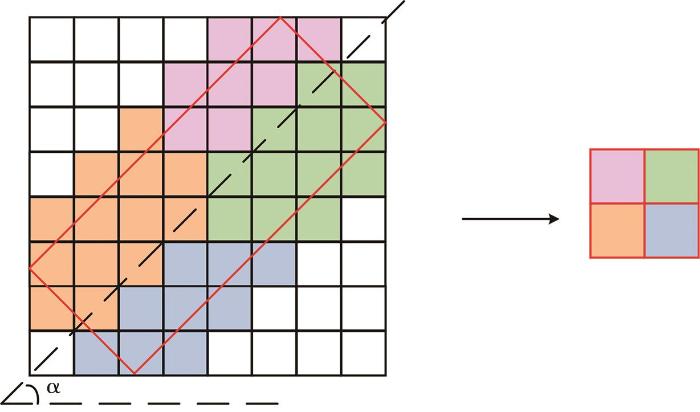

... 近几年,很多研究提出使用旋转包围框标记样本,在目标包围框参数中加入一个旋转角度α,以实现目标的旋转不变性检测[21,31-34],如图3所示.同时,通过设计自适应的感兴趣区(Region of Interest,ROI)池化层,以提取建议区域任意方向的有效特征[21,32-34],如图4所示.Yu等[34]同时设计了基于定向锚定的锚框生成子网络,其包含3个分支:位置预测分支通过生成概率图表示每个目标存在的概率;形状预测分支生成3个映射(宽度、高度和方向),预测与位置相关的锚点形状;特征自适应分支根据锚点形状对特征图进行校正. ...

... [21,32-34],如图4所示.Yu等[34]同时设计了基于定向锚定的锚框生成子网络,其包含3个分支:位置预测分支通过生成概率图表示每个目标存在的概率;形状预测分支生成3个映射(宽度、高度和方向),预测与位置相关的锚点形状;特征自适应分支根据锚点形状对特征图进行校正. ...

... The object detection methods of rotation invariance

Table 2| 文献 | 方法 | 特点 |

|---|

| Cheng等[29],2016 | 旋转不变特征层 | 在AlexNet网络中加入一个旋转不变层,通过正则化约束项优化目标函数,使旋转前后的训练样本具有相似特征,从而实现旋转不变性 |

| Cheng等[30],2019 | 旋转不变特征层和Fisher判别层 | 在通用的目标检测模型基础上,加入旋转不变正则化和Fisher判别正则化以解决目标旋转、类内多样性和类间相似度等问题 |

| Tang等[31],2017 | 导向矩形框 | 对包围框的偏移量加入一个角度参数,得到,通过默认包围框以及偏移量得到具有方向的矩形框 |

| Zhang等[32],2018 | 导向矩形框 | 在包围框参数中加入角度参数来预设锚点,得到五元组,并采用R2oI池化层进行最大池化操作 |

| Yang等[21],2018 | 导向矩形框 | 构建任意旋转矩形,并提出自适应的ROI Align结构自动过滤因旋转框造成的ROI噪声 |

| Dong等[33],2020 | 导向矩形框 | 构建任意旋转矩形,并设计旋转的ROI pooling进行最大池化 |

| Yu等[34],2020 | 导向矩形框 | 构建旋转矩形,设计导向锚点子网络,并构建旋转ROI pooling进行最大池化 |

2.1.3 解决复杂背景干扰的上下文信息提取遥感图像目标检测的一个难点在于目标背景过于复杂,且前景和背景不容易分离.大场景的遥感图像中往往包含多种地物,目标易受各类相似地物的颜色、纹理、形状等特征的干扰.同时由于遥感图像同类地物会呈现不同的特征,在进行目标检测时很容易产生误检. ...

... 为了解决靠岸船舶目标检测密集排列、背景复杂等问题,很多研究使用旋转包围框标记船舶样本[21,32-33,71-72],尽可能产生包含更多正样本信息的建议区域,避免复杂背景的干扰,同时这些方法通过构建旋转区域建议网络,来适应不同方向的船舶目标检测. ...

A Multiscale object detection approach for remote sensing images based on MSE-DenseNet and the dynamic anchor assignment

1

2019

... The object detection methods of scale invariance

Table 1| 文献 | 方法 | 特点 |

|---|

| Zhu等[20],2019 | 自下而上融合 | 受文献[27]启发,提取不同卷积层(conv3,conv4,conv5)候选区域对应的特征向量,经过兴趣特征池化层(ROI Pooling)、L2归一化,以促进多尺度特征融合 |

| Dong等[19],2020 | 自下而上融合 | 将进行膨胀扩张的卷积神经网络分支(conv4)和顶层卷积层的反卷积输出(conv5)融合,以有效利用高层语义信息 |

| Yang等[21],2018 | 自上而下融合 | 在ResNet网络基础上构建了5层特征金字塔 |

| Zhu等[22],2019 | 自上而下融合 | 在密集网络DenseNet上构建了3层特征金字塔网络以获取小目标特征 |

| Zhuang等[23],2019 | 自上而下融合 | 在Darknet-53网络基础上构建了3层特征金字塔 |

| Zhang等[24],2019 | 自上而下融合 | 构建了一种多尺度区域建议网络和多尺度目标检测网络,同时,提出了多尺度训练策略(使用基于斑块的多尺度训练数据以及使用多尺寸的图像进行训练)并进行消融实验 |

| Qiu等[25],2019 | 自上而下融合 | 在特征金字塔基础上加入一个门融合(gate fusion)模块,使得模型可以选择性地融合CNN不同尺度特征 |

| Cheng等[26],2020 | 自上而下以及跨尺度融合 | 在构建FPN的基础上,提出了一种跨尺度特征融合策略,对每个特征尺度进行特征融合和特征增强 |

2.1.2 实现旋转不变性的旋转感兴趣区对任意旋转角度的目标具备识别能力,以实现旋转不变性一直是目标检测领域的重要课题.遥感图像目标,如飞机、船舶等,目标比较狭长,一般呈现多种旋转角度,这就需要模型对任意旋转角度的目标具备较强的识别能力.当旋转目标之间排列紧密的情况下,仅使用最小矩形包围框标记样本,会增加无用的背景信息影响模型的判断,从而无法准确检测每个目标的位置. ...

A single shot framework with multi-scale feature fusion for geospatial object detection

1

2019

... The object detection methods of scale invariance

Table 1| 文献 | 方法 | 特点 |

|---|

| Zhu等[20],2019 | 自下而上融合 | 受文献[27]启发,提取不同卷积层(conv3,conv4,conv5)候选区域对应的特征向量,经过兴趣特征池化层(ROI Pooling)、L2归一化,以促进多尺度特征融合 |

| Dong等[19],2020 | 自下而上融合 | 将进行膨胀扩张的卷积神经网络分支(conv4)和顶层卷积层的反卷积输出(conv5)融合,以有效利用高层语义信息 |

| Yang等[21],2018 | 自上而下融合 | 在ResNet网络基础上构建了5层特征金字塔 |

| Zhu等[22],2019 | 自上而下融合 | 在密集网络DenseNet上构建了3层特征金字塔网络以获取小目标特征 |

| Zhuang等[23],2019 | 自上而下融合 | 在Darknet-53网络基础上构建了3层特征金字塔 |

| Zhang等[24],2019 | 自上而下融合 | 构建了一种多尺度区域建议网络和多尺度目标检测网络,同时,提出了多尺度训练策略(使用基于斑块的多尺度训练数据以及使用多尺寸的图像进行训练)并进行消融实验 |

| Qiu等[25],2019 | 自上而下融合 | 在特征金字塔基础上加入一个门融合(gate fusion)模块,使得模型可以选择性地融合CNN不同尺度特征 |

| Cheng等[26],2020 | 自上而下以及跨尺度融合 | 在构建FPN的基础上,提出了一种跨尺度特征融合策略,对每个特征尺度进行特征融合和特征增强 |

2.1.2 实现旋转不变性的旋转感兴趣区对任意旋转角度的目标具备识别能力,以实现旋转不变性一直是目标检测领域的重要课题.遥感图像目标,如飞机、船舶等,目标比较狭长,一般呈现多种旋转角度,这就需要模型对任意旋转角度的目标具备较强的识别能力.当旋转目标之间排列紧密的情况下,仅使用最小矩形包围框标记样本,会增加无用的背景信息影响模型的判断,从而无法准确检测每个目标的位置. ...

Geospatial object detection on high resolution remote sensing imagery based on double multi-scale feature Pyramid network

2

2019

... 自上而下的特征融合如图2所示,类似特征金字塔网络(Feature Pyramid Network,FPN)结构,自上而下将不同尺度的特征层分别与上一级高层特征上采样的结果融合,最终构成多级特征金字塔,每一层对应不同尺度的目标特征.Yang等[21-24]基于卷积神经网络构建特征金字塔进行特征融合,提高了小目标检测精度.在特征金字塔基础上,Qiu等[25]在每一层加入一个gate fusion模块,通过控制不同尺度特征信息流,来选择有效特征以抑制不相关特征.Cheng等[26]在FPN的基础上,提出了一种新的特征融合策略,通过融合跨尺度特征信息,以实现多尺度目标检测. ...

... The object detection methods of scale invariance

Table 1| 文献 | 方法 | 特点 |

|---|

| Zhu等[20],2019 | 自下而上融合 | 受文献[27]启发,提取不同卷积层(conv3,conv4,conv5)候选区域对应的特征向量,经过兴趣特征池化层(ROI Pooling)、L2归一化,以促进多尺度特征融合 |

| Dong等[19],2020 | 自下而上融合 | 将进行膨胀扩张的卷积神经网络分支(conv4)和顶层卷积层的反卷积输出(conv5)融合,以有效利用高层语义信息 |

| Yang等[21],2018 | 自上而下融合 | 在ResNet网络基础上构建了5层特征金字塔 |

| Zhu等[22],2019 | 自上而下融合 | 在密集网络DenseNet上构建了3层特征金字塔网络以获取小目标特征 |

| Zhuang等[23],2019 | 自上而下融合 | 在Darknet-53网络基础上构建了3层特征金字塔 |

| Zhang等[24],2019 | 自上而下融合 | 构建了一种多尺度区域建议网络和多尺度目标检测网络,同时,提出了多尺度训练策略(使用基于斑块的多尺度训练数据以及使用多尺寸的图像进行训练)并进行消融实验 |

| Qiu等[25],2019 | 自上而下融合 | 在特征金字塔基础上加入一个门融合(gate fusion)模块,使得模型可以选择性地融合CNN不同尺度特征 |

| Cheng等[26],2020 | 自上而下以及跨尺度融合 | 在构建FPN的基础上,提出了一种跨尺度特征融合策略,对每个特征尺度进行特征融合和特征增强 |

2.1.2 实现旋转不变性的旋转感兴趣区对任意旋转角度的目标具备识别能力,以实现旋转不变性一直是目标检测领域的重要课题.遥感图像目标,如飞机、船舶等,目标比较狭长,一般呈现多种旋转角度,这就需要模型对任意旋转角度的目标具备较强的识别能力.当旋转目标之间排列紧密的情况下,仅使用最小矩形包围框标记样本,会增加无用的背景信息影响模型的判断,从而无法准确检测每个目标的位置. ...

A2RMNet: Adaptively aspect ratio multi-scale network for object detection in remote sensing images

2

2019

... 自上而下的特征融合如图2所示,类似特征金字塔网络(Feature Pyramid Network,FPN)结构,自上而下将不同尺度的特征层分别与上一级高层特征上采样的结果融合,最终构成多级特征金字塔,每一层对应不同尺度的目标特征.Yang等[21-24]基于卷积神经网络构建特征金字塔进行特征融合,提高了小目标检测精度.在特征金字塔基础上,Qiu等[25]在每一层加入一个gate fusion模块,通过控制不同尺度特征信息流,来选择有效特征以抑制不相关特征.Cheng等[26]在FPN的基础上,提出了一种新的特征融合策略,通过融合跨尺度特征信息,以实现多尺度目标检测. ...

... The object detection methods of scale invariance

Table 1| 文献 | 方法 | 特点 |

|---|

| Zhu等[20],2019 | 自下而上融合 | 受文献[27]启发,提取不同卷积层(conv3,conv4,conv5)候选区域对应的特征向量,经过兴趣特征池化层(ROI Pooling)、L2归一化,以促进多尺度特征融合 |

| Dong等[19],2020 | 自下而上融合 | 将进行膨胀扩张的卷积神经网络分支(conv4)和顶层卷积层的反卷积输出(conv5)融合,以有效利用高层语义信息 |

| Yang等[21],2018 | 自上而下融合 | 在ResNet网络基础上构建了5层特征金字塔 |

| Zhu等[22],2019 | 自上而下融合 | 在密集网络DenseNet上构建了3层特征金字塔网络以获取小目标特征 |

| Zhuang等[23],2019 | 自上而下融合 | 在Darknet-53网络基础上构建了3层特征金字塔 |

| Zhang等[24],2019 | 自上而下融合 | 构建了一种多尺度区域建议网络和多尺度目标检测网络,同时,提出了多尺度训练策略(使用基于斑块的多尺度训练数据以及使用多尺寸的图像进行训练)并进行消融实验 |

| Qiu等[25],2019 | 自上而下融合 | 在特征金字塔基础上加入一个门融合(gate fusion)模块,使得模型可以选择性地融合CNN不同尺度特征 |

| Cheng等[26],2020 | 自上而下以及跨尺度融合 | 在构建FPN的基础上,提出了一种跨尺度特征融合策略,对每个特征尺度进行特征融合和特征增强 |

2.1.2 实现旋转不变性的旋转感兴趣区对任意旋转角度的目标具备识别能力,以实现旋转不变性一直是目标检测领域的重要课题.遥感图像目标,如飞机、船舶等,目标比较狭长,一般呈现多种旋转角度,这就需要模型对任意旋转角度的目标具备较强的识别能力.当旋转目标之间排列紧密的情况下,仅使用最小矩形包围框标记样本,会增加无用的背景信息影响模型的判断,从而无法准确检测每个目标的位置. ...

Cross-scale feature fusion for object detection in optical remote sensing images

2

2020

... 自上而下的特征融合如图2所示,类似特征金字塔网络(Feature Pyramid Network,FPN)结构,自上而下将不同尺度的特征层分别与上一级高层特征上采样的结果融合,最终构成多级特征金字塔,每一层对应不同尺度的目标特征.Yang等[21-24]基于卷积神经网络构建特征金字塔进行特征融合,提高了小目标检测精度.在特征金字塔基础上,Qiu等[25]在每一层加入一个gate fusion模块,通过控制不同尺度特征信息流,来选择有效特征以抑制不相关特征.Cheng等[26]在FPN的基础上,提出了一种新的特征融合策略,通过融合跨尺度特征信息,以实现多尺度目标检测. ...

... The object detection methods of scale invariance

Table 1| 文献 | 方法 | 特点 |

|---|

| Zhu等[20],2019 | 自下而上融合 | 受文献[27]启发,提取不同卷积层(conv3,conv4,conv5)候选区域对应的特征向量,经过兴趣特征池化层(ROI Pooling)、L2归一化,以促进多尺度特征融合 |

| Dong等[19],2020 | 自下而上融合 | 将进行膨胀扩张的卷积神经网络分支(conv4)和顶层卷积层的反卷积输出(conv5)融合,以有效利用高层语义信息 |

| Yang等[21],2018 | 自上而下融合 | 在ResNet网络基础上构建了5层特征金字塔 |

| Zhu等[22],2019 | 自上而下融合 | 在密集网络DenseNet上构建了3层特征金字塔网络以获取小目标特征 |

| Zhuang等[23],2019 | 自上而下融合 | 在Darknet-53网络基础上构建了3层特征金字塔 |

| Zhang等[24],2019 | 自上而下融合 | 构建了一种多尺度区域建议网络和多尺度目标检测网络,同时,提出了多尺度训练策略(使用基于斑块的多尺度训练数据以及使用多尺寸的图像进行训练)并进行消融实验 |

| Qiu等[25],2019 | 自上而下融合 | 在特征金字塔基础上加入一个门融合(gate fusion)模块,使得模型可以选择性地融合CNN不同尺度特征 |

| Cheng等[26],2020 | 自上而下以及跨尺度融合 | 在构建FPN的基础上,提出了一种跨尺度特征融合策略,对每个特征尺度进行特征融合和特征增强 |

2.1.2 实现旋转不变性的旋转感兴趣区对任意旋转角度的目标具备识别能力,以实现旋转不变性一直是目标检测领域的重要课题.遥感图像目标,如飞机、船舶等,目标比较狭长,一般呈现多种旋转角度,这就需要模型对任意旋转角度的目标具备较强的识别能力.当旋转目标之间排列紧密的情况下,仅使用最小矩形包围框标记样本,会增加无用的背景信息影响模型的判断,从而无法准确检测每个目标的位置. ...

ParseNet: Looking wider to see better

1

... The object detection methods of scale invariance

Table 1| 文献 | 方法 | 特点 |

|---|

| Zhu等[20],2019 | 自下而上融合 | 受文献[27]启发,提取不同卷积层(conv3,conv4,conv5)候选区域对应的特征向量,经过兴趣特征池化层(ROI Pooling)、L2归一化,以促进多尺度特征融合 |

| Dong等[19],2020 | 自下而上融合 | 将进行膨胀扩张的卷积神经网络分支(conv4)和顶层卷积层的反卷积输出(conv5)融合,以有效利用高层语义信息 |

| Yang等[21],2018 | 自上而下融合 | 在ResNet网络基础上构建了5层特征金字塔 |

| Zhu等[22],2019 | 自上而下融合 | 在密集网络DenseNet上构建了3层特征金字塔网络以获取小目标特征 |

| Zhuang等[23],2019 | 自上而下融合 | 在Darknet-53网络基础上构建了3层特征金字塔 |

| Zhang等[24],2019 | 自上而下融合 | 构建了一种多尺度区域建议网络和多尺度目标检测网络,同时,提出了多尺度训练策略(使用基于斑块的多尺度训练数据以及使用多尺寸的图像进行训练)并进行消融实验 |

| Qiu等[25],2019 | 自上而下融合 | 在特征金字塔基础上加入一个门融合(gate fusion)模块,使得模型可以选择性地融合CNN不同尺度特征 |

| Cheng等[26],2020 | 自上而下以及跨尺度融合 | 在构建FPN的基础上,提出了一种跨尺度特征融合策略,对每个特征尺度进行特征融合和特征增强 |

2.1.2 实现旋转不变性的旋转感兴趣区对任意旋转角度的目标具备识别能力,以实现旋转不变性一直是目标检测领域的重要课题.遥感图像目标,如飞机、船舶等,目标比较狭长,一般呈现多种旋转角度,这就需要模型对任意旋转角度的目标具备较强的识别能力.当旋转目标之间排列紧密的情况下,仅使用最小矩形包围框标记样本,会增加无用的背景信息影响模型的判断,从而无法准确检测每个目标的位置. ...

Scale adaptive proposal network for object detection in remote sensing images

1

2019

... 实现多层特征表达的主要目的是增强模型对多尺度目标特征的描述能力.可以通过构建多尺度特征金字塔,也可以基于区域建议网络(Region Proposal Network,RPN)构建多尺度建议框[28],即在两个卷积层上分别构建RPN.构建多尺度的建议框可以针对不同大小的目标设计不同的预设包围框,以生成不同尺度的建议区域,这种方法较直接预设多尺寸包围框更具有针对性. ...

Learning rotation-invariant convolutional neural networks for object detection in VHR optical remote sensing images

2

2016

... 为了有效分辨目标旋转前后的特征,Cheng等[29]提出在CNN结构的基础上加入一个新的全连接层,通过引入正则化约束条件来学习训练样本的旋转映射.或者可以通过加入旋转不变正则化和Fisher判别正则化来增强CNN的特征表达,以实现目标检测模型的旋转不变性[30]. ...

... The object detection methods of rotation invariance

Table 2| 文献 | 方法 | 特点 |

|---|

| Cheng等[29],2016 | 旋转不变特征层 | 在AlexNet网络中加入一个旋转不变层,通过正则化约束项优化目标函数,使旋转前后的训练样本具有相似特征,从而实现旋转不变性 |

| Cheng等[30],2019 | 旋转不变特征层和Fisher判别层 | 在通用的目标检测模型基础上,加入旋转不变正则化和Fisher判别正则化以解决目标旋转、类内多样性和类间相似度等问题 |

| Tang等[31],2017 | 导向矩形框 | 对包围框的偏移量加入一个角度参数,得到,通过默认包围框以及偏移量得到具有方向的矩形框 |

| Zhang等[32],2018 | 导向矩形框 | 在包围框参数中加入角度参数来预设锚点,得到五元组,并采用R2oI池化层进行最大池化操作 |

| Yang等[21],2018 | 导向矩形框 | 构建任意旋转矩形,并提出自适应的ROI Align结构自动过滤因旋转框造成的ROI噪声 |

| Dong等[33],2020 | 导向矩形框 | 构建任意旋转矩形,并设计旋转的ROI pooling进行最大池化 |

| Yu等[34],2020 | 导向矩形框 | 构建旋转矩形,设计导向锚点子网络,并构建旋转ROI pooling进行最大池化 |

2.1.3 解决复杂背景干扰的上下文信息提取遥感图像目标检测的一个难点在于目标背景过于复杂,且前景和背景不容易分离.大场景的遥感图像中往往包含多种地物,目标易受各类相似地物的颜色、纹理、形状等特征的干扰.同时由于遥感图像同类地物会呈现不同的特征,在进行目标检测时很容易产生误检. ...

Learning rotation-invariant and fisher discriminative convolutional neural networks for object detection

2

2019

... 为了有效分辨目标旋转前后的特征,Cheng等[29]提出在CNN结构的基础上加入一个新的全连接层,通过引入正则化约束条件来学习训练样本的旋转映射.或者可以通过加入旋转不变正则化和Fisher判别正则化来增强CNN的特征表达,以实现目标检测模型的旋转不变性[30]. ...

... The object detection methods of rotation invariance

Table 2| 文献 | 方法 | 特点 |

|---|

| Cheng等[29],2016 | 旋转不变特征层 | 在AlexNet网络中加入一个旋转不变层,通过正则化约束项优化目标函数,使旋转前后的训练样本具有相似特征,从而实现旋转不变性 |

| Cheng等[30],2019 | 旋转不变特征层和Fisher判别层 | 在通用的目标检测模型基础上,加入旋转不变正则化和Fisher判别正则化以解决目标旋转、类内多样性和类间相似度等问题 |

| Tang等[31],2017 | 导向矩形框 | 对包围框的偏移量加入一个角度参数,得到,通过默认包围框以及偏移量得到具有方向的矩形框 |

| Zhang等[32],2018 | 导向矩形框 | 在包围框参数中加入角度参数来预设锚点,得到五元组,并采用R2oI池化层进行最大池化操作 |

| Yang等[21],2018 | 导向矩形框 | 构建任意旋转矩形,并提出自适应的ROI Align结构自动过滤因旋转框造成的ROI噪声 |

| Dong等[33],2020 | 导向矩形框 | 构建任意旋转矩形,并设计旋转的ROI pooling进行最大池化 |

| Yu等[34],2020 | 导向矩形框 | 构建旋转矩形,设计导向锚点子网络,并构建旋转ROI pooling进行最大池化 |

2.1.3 解决复杂背景干扰的上下文信息提取遥感图像目标检测的一个难点在于目标背景过于复杂,且前景和背景不容易分离.大场景的遥感图像中往往包含多种地物,目标易受各类相似地物的颜色、纹理、形状等特征的干扰.同时由于遥感图像同类地物会呈现不同的特征,在进行目标检测时很容易产生误检. ...

Arbitrary-oriented vehicle detection in aerial imagery with single convolutional neural networks

3

2017

... 近几年,很多研究提出使用旋转包围框标记样本,在目标包围框参数中加入一个旋转角度α,以实现目标的旋转不变性检测[21,31-34],如图3所示.同时,通过设计自适应的感兴趣区(Region of Interest,ROI)池化层,以提取建议区域任意方向的有效特征[21,32-34],如图4所示.Yu等[34]同时设计了基于定向锚定的锚框生成子网络,其包含3个分支:位置预测分支通过生成概率图表示每个目标存在的概率;形状预测分支生成3个映射(宽度、高度和方向),预测与位置相关的锚点形状;特征自适应分支根据锚点形状对特征图进行校正. ...

... The object detection methods of rotation invariance

Table 2| 文献 | 方法 | 特点 |

|---|

| Cheng等[29],2016 | 旋转不变特征层 | 在AlexNet网络中加入一个旋转不变层,通过正则化约束项优化目标函数,使旋转前后的训练样本具有相似特征,从而实现旋转不变性 |

| Cheng等[30],2019 | 旋转不变特征层和Fisher判别层 | 在通用的目标检测模型基础上,加入旋转不变正则化和Fisher判别正则化以解决目标旋转、类内多样性和类间相似度等问题 |

| Tang等[31],2017 | 导向矩形框 | 对包围框的偏移量加入一个角度参数,得到,通过默认包围框以及偏移量得到具有方向的矩形框 |

| Zhang等[32],2018 | 导向矩形框 | 在包围框参数中加入角度参数来预设锚点,得到五元组,并采用R2oI池化层进行最大池化操作 |

| Yang等[21],2018 | 导向矩形框 | 构建任意旋转矩形,并提出自适应的ROI Align结构自动过滤因旋转框造成的ROI噪声 |

| Dong等[33],2020 | 导向矩形框 | 构建任意旋转矩形,并设计旋转的ROI pooling进行最大池化 |

| Yu等[34],2020 | 导向矩形框 | 构建旋转矩形,设计导向锚点子网络,并构建旋转ROI pooling进行最大池化 |

2.1.3 解决复杂背景干扰的上下文信息提取遥感图像目标检测的一个难点在于目标背景过于复杂,且前景和背景不容易分离.大场景的遥感图像中往往包含多种地物,目标易受各类相似地物的颜色、纹理、形状等特征的干扰.同时由于遥感图像同类地物会呈现不同的特征,在进行目标检测时很容易产生误检. ...

... 为实现车辆目标检测中任意方向建议框的预测,Tang等[31]提出了一种导向型的车辆目标检测网络Oriented_SSD,通过产生具有方向性的包围框以更准确地提取不同旋转方向的车辆.Yu等[76]通过对图像进行超像素分割来生成具有意义的斑块,将其输入到卷积胶囊网络中以有效检测不同尺度、方向和遮挡水平的车辆. ...

Toward arbitrary-oriented ship detection with rotated region proposal and discrimination networks

3

2018

... 近几年,很多研究提出使用旋转包围框标记样本,在目标包围框参数中加入一个旋转角度α,以实现目标的旋转不变性检测[21,31-34],如图3所示.同时,通过设计自适应的感兴趣区(Region of Interest,ROI)池化层,以提取建议区域任意方向的有效特征[21,32-34],如图4所示.Yu等[34]同时设计了基于定向锚定的锚框生成子网络,其包含3个分支:位置预测分支通过生成概率图表示每个目标存在的概率;形状预测分支生成3个映射(宽度、高度和方向),预测与位置相关的锚点形状;特征自适应分支根据锚点形状对特征图进行校正. ...

... The object detection methods of rotation invariance

Table 2| 文献 | 方法 | 特点 |

|---|

| Cheng等[29],2016 | 旋转不变特征层 | 在AlexNet网络中加入一个旋转不变层,通过正则化约束项优化目标函数,使旋转前后的训练样本具有相似特征,从而实现旋转不变性 |

| Cheng等[30],2019 | 旋转不变特征层和Fisher判别层 | 在通用的目标检测模型基础上,加入旋转不变正则化和Fisher判别正则化以解决目标旋转、类内多样性和类间相似度等问题 |

| Tang等[31],2017 | 导向矩形框 | 对包围框的偏移量加入一个角度参数,得到,通过默认包围框以及偏移量得到具有方向的矩形框 |

| Zhang等[32],2018 | 导向矩形框 | 在包围框参数中加入角度参数来预设锚点,得到五元组,并采用R2oI池化层进行最大池化操作 |

| Yang等[21],2018 | 导向矩形框 | 构建任意旋转矩形,并提出自适应的ROI Align结构自动过滤因旋转框造成的ROI噪声 |

| Dong等[33],2020 | 导向矩形框 | 构建任意旋转矩形,并设计旋转的ROI pooling进行最大池化 |

| Yu等[34],2020 | 导向矩形框 | 构建旋转矩形,设计导向锚点子网络,并构建旋转ROI pooling进行最大池化 |

2.1.3 解决复杂背景干扰的上下文信息提取遥感图像目标检测的一个难点在于目标背景过于复杂,且前景和背景不容易分离.大场景的遥感图像中往往包含多种地物,目标易受各类相似地物的颜色、纹理、形状等特征的干扰.同时由于遥感图像同类地物会呈现不同的特征,在进行目标检测时很容易产生误检. ...

... 为了解决靠岸船舶目标检测密集排列、背景复杂等问题,很多研究使用旋转包围框标记船舶样本[21,32-33,71-72],尽可能产生包含更多正样本信息的建议区域,避免复杂背景的干扰,同时这些方法通过构建旋转区域建议网络,来适应不同方向的船舶目标检测. ...

Learning a robust CNN-based rotation insensitive model for ship detection in VHR remote sensing images

2

2020

... The object detection methods of rotation invariance

Table 2| 文献 | 方法 | 特点 |

|---|

| Cheng等[29],2016 | 旋转不变特征层 | 在AlexNet网络中加入一个旋转不变层,通过正则化约束项优化目标函数,使旋转前后的训练样本具有相似特征,从而实现旋转不变性 |

| Cheng等[30],2019 | 旋转不变特征层和Fisher判别层 | 在通用的目标检测模型基础上,加入旋转不变正则化和Fisher判别正则化以解决目标旋转、类内多样性和类间相似度等问题 |

| Tang等[31],2017 | 导向矩形框 | 对包围框的偏移量加入一个角度参数,得到,通过默认包围框以及偏移量得到具有方向的矩形框 |

| Zhang等[32],2018 | 导向矩形框 | 在包围框参数中加入角度参数来预设锚点,得到五元组,并采用R2oI池化层进行最大池化操作 |

| Yang等[21],2018 | 导向矩形框 | 构建任意旋转矩形,并提出自适应的ROI Align结构自动过滤因旋转框造成的ROI噪声 |

| Dong等[33],2020 | 导向矩形框 | 构建任意旋转矩形,并设计旋转的ROI pooling进行最大池化 |

| Yu等[34],2020 | 导向矩形框 | 构建旋转矩形,设计导向锚点子网络,并构建旋转ROI pooling进行最大池化 |

2.1.3 解决复杂背景干扰的上下文信息提取遥感图像目标检测的一个难点在于目标背景过于复杂,且前景和背景不容易分离.大场景的遥感图像中往往包含多种地物,目标易受各类相似地物的颜色、纹理、形状等特征的干扰.同时由于遥感图像同类地物会呈现不同的特征,在进行目标检测时很容易产生误检. ...

... 为了解决靠岸船舶目标检测密集排列、背景复杂等问题,很多研究使用旋转包围框标记船舶样本[21,32-33,71-72],尽可能产生包含更多正样本信息的建议区域,避免复杂背景的干扰,同时这些方法通过构建旋转区域建议网络,来适应不同方向的船舶目标检测. ...

Orientation guided anchoring for geospatial object detection from remote sensing imagery

4

2020

... 近几年,很多研究提出使用旋转包围框标记样本,在目标包围框参数中加入一个旋转角度α,以实现目标的旋转不变性检测[21,31-34],如图3所示.同时,通过设计自适应的感兴趣区(Region of Interest,ROI)池化层,以提取建议区域任意方向的有效特征[21,32-34],如图4所示.Yu等[34]同时设计了基于定向锚定的锚框生成子网络,其包含3个分支:位置预测分支通过生成概率图表示每个目标存在的概率;形状预测分支生成3个映射(宽度、高度和方向),预测与位置相关的锚点形状;特征自适应分支根据锚点形状对特征图进行校正. ...

... -34],如图4所示.Yu等[34]同时设计了基于定向锚定的锚框生成子网络,其包含3个分支:位置预测分支通过生成概率图表示每个目标存在的概率;形状预测分支生成3个映射(宽度、高度和方向),预测与位置相关的锚点形状;特征自适应分支根据锚点形状对特征图进行校正. ...

... [34]同时设计了基于定向锚定的锚框生成子网络,其包含3个分支:位置预测分支通过生成概率图表示每个目标存在的概率;形状预测分支生成3个映射(宽度、高度和方向),预测与位置相关的锚点形状;特征自适应分支根据锚点形状对特征图进行校正. ...

... The object detection methods of rotation invariance

Table 2| 文献 | 方法 | 特点 |

|---|

| Cheng等[29],2016 | 旋转不变特征层 | 在AlexNet网络中加入一个旋转不变层,通过正则化约束项优化目标函数,使旋转前后的训练样本具有相似特征,从而实现旋转不变性 |

| Cheng等[30],2019 | 旋转不变特征层和Fisher判别层 | 在通用的目标检测模型基础上,加入旋转不变正则化和Fisher判别正则化以解决目标旋转、类内多样性和类间相似度等问题 |

| Tang等[31],2017 | 导向矩形框 | 对包围框的偏移量加入一个角度参数,得到,通过默认包围框以及偏移量得到具有方向的矩形框 |

| Zhang等[32],2018 | 导向矩形框 | 在包围框参数中加入角度参数来预设锚点,得到五元组,并采用R2oI池化层进行最大池化操作 |

| Yang等[21],2018 | 导向矩形框 | 构建任意旋转矩形,并提出自适应的ROI Align结构自动过滤因旋转框造成的ROI噪声 |

| Dong等[33],2020 | 导向矩形框 | 构建任意旋转矩形,并设计旋转的ROI pooling进行最大池化 |

| Yu等[34],2020 | 导向矩形框 | 构建旋转矩形,设计导向锚点子网络,并构建旋转ROI pooling进行最大池化 |

2.1.3 解决复杂背景干扰的上下文信息提取遥感图像目标检测的一个难点在于目标背景过于复杂,且前景和背景不容易分离.大场景的遥感图像中往往包含多种地物,目标易受各类相似地物的颜色、纹理、形状等特征的干扰.同时由于遥感图像同类地物会呈现不同的特征,在进行目标检测时很容易产生误检. ...

The role of context for object detection and semantic segmentation in the wild

1

2014

... 上下文信息(Contextual Information)通常被理解为图像中可察觉并影响目标检测结果的有效信息,对计算机视觉任务起着至关重要的作用[35-36].人眼在观察图像时,可以快速的获得目标区域,聚焦于该区域以获取更多有效细节,同时忽略其它无用信息.计算机视觉中的上下文信息与人类的视觉注意机制相似,其目的是从大量信息中为当前任务选择较关键的信息.目标对象通常与周围环境相关联,嵌入到周围环境的目标构成典型的上下文信息.研究如何提取目标的上下文信息,探究目标与背景之间的约束关系,可以更有利于目标的特征学习,这在目标检测中具有突出优势. ...

Going deeper with convolutions

1

2015

... 上下文信息(Contextual Information)通常被理解为图像中可察觉并影响目标检测结果的有效信息,对计算机视觉任务起着至关重要的作用[35-36].人眼在观察图像时,可以快速的获得目标区域,聚焦于该区域以获取更多有效细节,同时忽略其它无用信息.计算机视觉中的上下文信息与人类的视觉注意机制相似,其目的是从大量信息中为当前任务选择较关键的信息.目标对象通常与周围环境相关联,嵌入到周围环境的目标构成典型的上下文信息.研究如何提取目标的上下文信息,探究目标与背景之间的约束关系,可以更有利于目标的特征学习,这在目标检测中具有突出优势. ...

Rotation-insensitive and context-augmented object detection in remote sensing images

2

2018

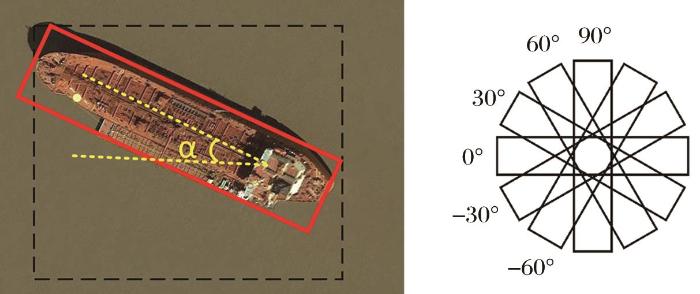

... 实现复杂背景下的目标检测,可以通过提取目标的上下文信息,解读图像局部和全局的视觉信息,从而增强模型对目标的识别能力.目标的上下文信息范围如图5所示.很多研究者通过挖掘一定范围的ROI上下文局部信息,将ROI及上下文信息特征进行融合[37-39],亦或基于上下文交互,探索目标和场景之间的相关性,聚焦更丰富的信息区域,抑制无效信息[40]. ...

... The object detection methods of complex information

Table 3| 文献 | 方法 | 特点 |

|---|

| Li等[37],2018 | 提取局部上下文特征 | 构建了一种基于混合限制玻尔兹曼机的双通道框架,融合了局部和上下文特征(分别提取原始建议框1倍和1.5倍特征) |

| Ren等[38],2018 | 提取上下文信息 | 将提取的上下文区域和RPN产生的建议区域分别经过ROI pooling层,之后连接两部分向量用于预测 |

| Zhang等[40],2019 | 提取全局上下文信息及构建注意力模块 | 设计了一种全局上下文敏感网络,GCNet,来学习全局场景语义;提出了空间感知模块,以关注图像上信息更丰富的区域 |

| Gong等[39],2020 | 提取局部上下文信息 | 对每个ROI挖掘一个自适应的上下文ROI提取上下文特征(定义3倍ROI区域为有效的上下文区域) |

| Chen等[41],2018 | 注意力模块 | 提出了一种两层注意力机制模块,结合了局部和全局信息 |

| Pang等[43],2019 | 注意力模块 | 基于特征金字塔池化构建了一种全局注意力模块 |

| 李红艳等[44],2019 | 注意力模块 | 使用结合空间和通道的注意力机制模块CBAM |

2.1.4 解决样本量少的弱监督学习基于深度学习的目标检测方法需要大量样本进行训练,而获取大量的样本需要很高的人工成本和时间成本.现有研究大多是基于迁移学习[45-47],将基于自然图像的预训练模型进行微调训练后,用于遥感图像目标检测.然而,遥感图像中的目标往往拍摄视角单一,尺度变化大,且所处的背景环境复杂,使得目标的特征表达与自然图像存在较大的差异.因此,仅依靠迁移学习方法的遥感图像目标检测可能得不到较好的检测结果. ...

Small object detection in optical remote sensing images via modified faster R-CNN

1

2018

... The object detection methods of complex information

Table 3| 文献 | 方法 | 特点 |

|---|

| Li等[37],2018 | 提取局部上下文特征 | 构建了一种基于混合限制玻尔兹曼机的双通道框架,融合了局部和上下文特征(分别提取原始建议框1倍和1.5倍特征) |

| Ren等[38],2018 | 提取上下文信息 | 将提取的上下文区域和RPN产生的建议区域分别经过ROI pooling层,之后连接两部分向量用于预测 |

| Zhang等[40],2019 | 提取全局上下文信息及构建注意力模块 | 设计了一种全局上下文敏感网络,GCNet,来学习全局场景语义;提出了空间感知模块,以关注图像上信息更丰富的区域 |

| Gong等[39],2020 | 提取局部上下文信息 | 对每个ROI挖掘一个自适应的上下文ROI提取上下文特征(定义3倍ROI区域为有效的上下文区域) |

| Chen等[41],2018 | 注意力模块 | 提出了一种两层注意力机制模块,结合了局部和全局信息 |

| Pang等[43],2019 | 注意力模块 | 基于特征金字塔池化构建了一种全局注意力模块 |

| 李红艳等[44],2019 | 注意力模块 | 使用结合空间和通道的注意力机制模块CBAM |

2.1.4 解决样本量少的弱监督学习基于深度学习的目标检测方法需要大量样本进行训练,而获取大量的样本需要很高的人工成本和时间成本.现有研究大多是基于迁移学习[45-47],将基于自然图像的预训练模型进行微调训练后,用于遥感图像目标检测.然而,遥感图像中的目标往往拍摄视角单一,尺度变化大,且所处的背景环境复杂,使得目标的特征表达与自然图像存在较大的差异.因此,仅依靠迁移学习方法的遥感图像目标检测可能得不到较好的检测结果. ...

Context-aware donvolutional neural network for object detection in VHR remote sensing imagery

2

2020

... 实现复杂背景下的目标检测,可以通过提取目标的上下文信息,解读图像局部和全局的视觉信息,从而增强模型对目标的识别能力.目标的上下文信息范围如图5所示.很多研究者通过挖掘一定范围的ROI上下文局部信息,将ROI及上下文信息特征进行融合[37-39],亦或基于上下文交互,探索目标和场景之间的相关性,聚焦更丰富的信息区域,抑制无效信息[40]. ...

... The object detection methods of complex information

Table 3| 文献 | 方法 | 特点 |

|---|

| Li等[37],2018 | 提取局部上下文特征 | 构建了一种基于混合限制玻尔兹曼机的双通道框架,融合了局部和上下文特征(分别提取原始建议框1倍和1.5倍特征) |

| Ren等[38],2018 | 提取上下文信息 | 将提取的上下文区域和RPN产生的建议区域分别经过ROI pooling层,之后连接两部分向量用于预测 |

| Zhang等[40],2019 | 提取全局上下文信息及构建注意力模块 | 设计了一种全局上下文敏感网络,GCNet,来学习全局场景语义;提出了空间感知模块,以关注图像上信息更丰富的区域 |

| Gong等[39],2020 | 提取局部上下文信息 | 对每个ROI挖掘一个自适应的上下文ROI提取上下文特征(定义3倍ROI区域为有效的上下文区域) |

| Chen等[41],2018 | 注意力模块 | 提出了一种两层注意力机制模块,结合了局部和全局信息 |

| Pang等[43],2019 | 注意力模块 | 基于特征金字塔池化构建了一种全局注意力模块 |

| 李红艳等[44],2019 | 注意力模块 | 使用结合空间和通道的注意力机制模块CBAM |

2.1.4 解决样本量少的弱监督学习基于深度学习的目标检测方法需要大量样本进行训练,而获取大量的样本需要很高的人工成本和时间成本.现有研究大多是基于迁移学习[45-47],将基于自然图像的预训练模型进行微调训练后,用于遥感图像目标检测.然而,遥感图像中的目标往往拍摄视角单一,尺度变化大,且所处的背景环境复杂,使得目标的特征表达与自然图像存在较大的差异.因此,仅依靠迁移学习方法的遥感图像目标检测可能得不到较好的检测结果. ...

CAD-Net: A context-aware detection network for objects in remote sensing imagery

2

2019

... 实现复杂背景下的目标检测,可以通过提取目标的上下文信息,解读图像局部和全局的视觉信息,从而增强模型对目标的识别能力.目标的上下文信息范围如图5所示.很多研究者通过挖掘一定范围的ROI上下文局部信息,将ROI及上下文信息特征进行融合[37-39],亦或基于上下文交互,探索目标和场景之间的相关性,聚焦更丰富的信息区域,抑制无效信息[40]. ...

... The object detection methods of complex information

Table 3| 文献 | 方法 | 特点 |

|---|

| Li等[37],2018 | 提取局部上下文特征 | 构建了一种基于混合限制玻尔兹曼机的双通道框架,融合了局部和上下文特征(分别提取原始建议框1倍和1.5倍特征) |

| Ren等[38],2018 | 提取上下文信息 | 将提取的上下文区域和RPN产生的建议区域分别经过ROI pooling层,之后连接两部分向量用于预测 |

| Zhang等[40],2019 | 提取全局上下文信息及构建注意力模块 | 设计了一种全局上下文敏感网络,GCNet,来学习全局场景语义;提出了空间感知模块,以关注图像上信息更丰富的区域 |

| Gong等[39],2020 | 提取局部上下文信息 | 对每个ROI挖掘一个自适应的上下文ROI提取上下文特征(定义3倍ROI区域为有效的上下文区域) |

| Chen等[41],2018 | 注意力模块 | 提出了一种两层注意力机制模块,结合了局部和全局信息 |

| Pang等[43],2019 | 注意力模块 | 基于特征金字塔池化构建了一种全局注意力模块 |

| 李红艳等[44],2019 | 注意力模块 | 使用结合空间和通道的注意力机制模块CBAM |

2.1.4 解决样本量少的弱监督学习基于深度学习的目标检测方法需要大量样本进行训练,而获取大量的样本需要很高的人工成本和时间成本.现有研究大多是基于迁移学习[45-47],将基于自然图像的预训练模型进行微调训练后,用于遥感图像目标检测.然而,遥感图像中的目标往往拍摄视角单一,尺度变化大,且所处的背景环境复杂,使得目标的特征表达与自然图像存在较大的差异.因此,仅依靠迁移学习方法的遥感图像目标检测可能得不到较好的检测结果. ...

Geospatial object detection in remote sensing imagery based on multiscale single-shot detector with activated semantics

2

2018

... 近年来,很多研究在卷积神经网络中引入注意力模块,联合空间和通道的相关性来进行特征建模.Chen等[41]提出了一种并发注意力结构CBA,采用两个SE(Squeeze-and-Excitation)[42]模块分别提取通道和全局的信息.Pang等[43]构建了一个特征金字塔池化层作为全局注意力模块,其与特征提取网络相连接,可以融合不同尺度的特征,以获取更丰富的上下文信息,使得检测器更容易分辨较小目标.李红艳等[44]在CNN模型中引入注意力机制,同时改进了非极大抑制(Non-Maximum Suppression, NMS)算法来解决遥感图像复杂背景、小目标检测等问题. ...

... The object detection methods of complex information

Table 3| 文献 | 方法 | 特点 |

|---|

| Li等[37],2018 | 提取局部上下文特征 | 构建了一种基于混合限制玻尔兹曼机的双通道框架,融合了局部和上下文特征(分别提取原始建议框1倍和1.5倍特征) |

| Ren等[38],2018 | 提取上下文信息 | 将提取的上下文区域和RPN产生的建议区域分别经过ROI pooling层,之后连接两部分向量用于预测 |

| Zhang等[40],2019 | 提取全局上下文信息及构建注意力模块 | 设计了一种全局上下文敏感网络,GCNet,来学习全局场景语义;提出了空间感知模块,以关注图像上信息更丰富的区域 |

| Gong等[39],2020 | 提取局部上下文信息 | 对每个ROI挖掘一个自适应的上下文ROI提取上下文特征(定义3倍ROI区域为有效的上下文区域) |

| Chen等[41],2018 | 注意力模块 | 提出了一种两层注意力机制模块,结合了局部和全局信息 |

| Pang等[43],2019 | 注意力模块 | 基于特征金字塔池化构建了一种全局注意力模块 |

| 李红艳等[44],2019 | 注意力模块 | 使用结合空间和通道的注意力机制模块CBAM |

2.1.4 解决样本量少的弱监督学习基于深度学习的目标检测方法需要大量样本进行训练,而获取大量的样本需要很高的人工成本和时间成本.现有研究大多是基于迁移学习[45-47],将基于自然图像的预训练模型进行微调训练后,用于遥感图像目标检测.然而,遥感图像中的目标往往拍摄视角单一,尺度变化大,且所处的背景环境复杂,使得目标的特征表达与自然图像存在较大的差异.因此,仅依靠迁移学习方法的遥感图像目标检测可能得不到较好的检测结果. ...

Squeeze-and-excitation networks

1

2018

... 近年来,很多研究在卷积神经网络中引入注意力模块,联合空间和通道的相关性来进行特征建模.Chen等[41]提出了一种并发注意力结构CBA,采用两个SE(Squeeze-and-Excitation)[42]模块分别提取通道和全局的信息.Pang等[43]构建了一个特征金字塔池化层作为全局注意力模块,其与特征提取网络相连接,可以融合不同尺度的特征,以获取更丰富的上下文信息,使得检测器更容易分辨较小目标.李红艳等[44]在CNN模型中引入注意力机制,同时改进了非极大抑制(Non-Maximum Suppression, NMS)算法来解决遥感图像复杂背景、小目标检测等问题. ...

R2CNN: Fast tiny object detection in large-scale remote sensing images

3

2019

... 近年来,很多研究在卷积神经网络中引入注意力模块,联合空间和通道的相关性来进行特征建模.Chen等[41]提出了一种并发注意力结构CBA,采用两个SE(Squeeze-and-Excitation)[42]模块分别提取通道和全局的信息.Pang等[43]构建了一个特征金字塔池化层作为全局注意力模块,其与特征提取网络相连接,可以融合不同尺度的特征,以获取更丰富的上下文信息,使得检测器更容易分辨较小目标.李红艳等[44]在CNN模型中引入注意力机制,同时改进了非极大抑制(Non-Maximum Suppression, NMS)算法来解决遥感图像复杂背景、小目标检测等问题. ...

... The object detection methods of complex information

Table 3| 文献 | 方法 | 特点 |

|---|

| Li等[37],2018 | 提取局部上下文特征 | 构建了一种基于混合限制玻尔兹曼机的双通道框架,融合了局部和上下文特征(分别提取原始建议框1倍和1.5倍特征) |

| Ren等[38],2018 | 提取上下文信息 | 将提取的上下文区域和RPN产生的建议区域分别经过ROI pooling层,之后连接两部分向量用于预测 |

| Zhang等[40],2019 | 提取全局上下文信息及构建注意力模块 | 设计了一种全局上下文敏感网络,GCNet,来学习全局场景语义;提出了空间感知模块,以关注图像上信息更丰富的区域 |

| Gong等[39],2020 | 提取局部上下文信息 | 对每个ROI挖掘一个自适应的上下文ROI提取上下文特征(定义3倍ROI区域为有效的上下文区域) |

| Chen等[41],2018 | 注意力模块 | 提出了一种两层注意力机制模块,结合了局部和全局信息 |

| Pang等[43],2019 | 注意力模块 | 基于特征金字塔池化构建了一种全局注意力模块 |

| 李红艳等[44],2019 | 注意力模块 | 使用结合空间和通道的注意力机制模块CBAM |

2.1.4 解决样本量少的弱监督学习基于深度学习的目标检测方法需要大量样本进行训练,而获取大量的样本需要很高的人工成本和时间成本.现有研究大多是基于迁移学习[45-47],将基于自然图像的预训练模型进行微调训练后,用于遥感图像目标检测.然而,遥感图像中的目标往往拍摄视角单一,尺度变化大,且所处的背景环境复杂,使得目标的特征表达与自然图像存在较大的差异.因此,仅依靠迁移学习方法的遥感图像目标检测可能得不到较好的检测结果. ...

... 针对飞机目标检测中的弱小目标表征能力不足等问题,现有研究大多使用多尺度特征融合的方法[20,62-63],以提高小目标的检测能力.大尺度遥感图像在分割预处理时,容易丢失较小的飞机目标,Chen等[64]提出了一种端到端的飞机目标检测算法,在输入层前和输出层后分别加入MultiBlock层和MapBlock层,将输入图像调整尺寸为均匀大小,最后将输出的检测结果图映射与输入图尺寸一致.此外,大尺度下小目标特征不突出,容易与非目标类别混淆,通过在卷积网络中加入注意力模块[43]或者引入空洞残差进行多尺度特征融合[65],捕捉目标的上下文信息,从而提高模型的特征表达能力. ...

注意力机制改进卷积神经网络的遥感图像目标检测

2

2019

... 近年来,很多研究在卷积神经网络中引入注意力模块,联合空间和通道的相关性来进行特征建模.Chen等[41]提出了一种并发注意力结构CBA,采用两个SE(Squeeze-and-Excitation)[42]模块分别提取通道和全局的信息.Pang等[43]构建了一个特征金字塔池化层作为全局注意力模块,其与特征提取网络相连接,可以融合不同尺度的特征,以获取更丰富的上下文信息,使得检测器更容易分辨较小目标.李红艳等[44]在CNN模型中引入注意力机制,同时改进了非极大抑制(Non-Maximum Suppression, NMS)算法来解决遥感图像复杂背景、小目标检测等问题. ...

... The object detection methods of complex information

Table 3| 文献 | 方法 | 特点 |

|---|

| Li等[37],2018 | 提取局部上下文特征 | 构建了一种基于混合限制玻尔兹曼机的双通道框架,融合了局部和上下文特征(分别提取原始建议框1倍和1.5倍特征) |

| Ren等[38],2018 | 提取上下文信息 | 将提取的上下文区域和RPN产生的建议区域分别经过ROI pooling层,之后连接两部分向量用于预测 |

| Zhang等[40],2019 | 提取全局上下文信息及构建注意力模块 | 设计了一种全局上下文敏感网络,GCNet,来学习全局场景语义;提出了空间感知模块,以关注图像上信息更丰富的区域 |

| Gong等[39],2020 | 提取局部上下文信息 | 对每个ROI挖掘一个自适应的上下文ROI提取上下文特征(定义3倍ROI区域为有效的上下文区域) |

| Chen等[41],2018 | 注意力模块 | 提出了一种两层注意力机制模块,结合了局部和全局信息 |

| Pang等[43],2019 | 注意力模块 | 基于特征金字塔池化构建了一种全局注意力模块 |

| 李红艳等[44],2019 | 注意力模块 | 使用结合空间和通道的注意力机制模块CBAM |

2.1.4 解决样本量少的弱监督学习基于深度学习的目标检测方法需要大量样本进行训练,而获取大量的样本需要很高的人工成本和时间成本.现有研究大多是基于迁移学习[45-47],将基于自然图像的预训练模型进行微调训练后,用于遥感图像目标检测.然而,遥感图像中的目标往往拍摄视角单一,尺度变化大,且所处的背景环境复杂,使得目标的特征表达与自然图像存在较大的差异.因此,仅依靠迁移学习方法的遥感图像目标检测可能得不到较好的检测结果. ...

注意力机制改进卷积神经网络的遥感图像目标检测

2

2019

... 近年来,很多研究在卷积神经网络中引入注意力模块,联合空间和通道的相关性来进行特征建模.Chen等[41]提出了一种并发注意力结构CBA,采用两个SE(Squeeze-and-Excitation)[42]模块分别提取通道和全局的信息.Pang等[43]构建了一个特征金字塔池化层作为全局注意力模块,其与特征提取网络相连接,可以融合不同尺度的特征,以获取更丰富的上下文信息,使得检测器更容易分辨较小目标.李红艳等[44]在CNN模型中引入注意力机制,同时改进了非极大抑制(Non-Maximum Suppression, NMS)算法来解决遥感图像复杂背景、小目标检测等问题. ...

... The object detection methods of complex information

Table 3| 文献 | 方法 | 特点 |

|---|

| Li等[37],2018 | 提取局部上下文特征 | 构建了一种基于混合限制玻尔兹曼机的双通道框架,融合了局部和上下文特征(分别提取原始建议框1倍和1.5倍特征) |

| Ren等[38],2018 | 提取上下文信息 | 将提取的上下文区域和RPN产生的建议区域分别经过ROI pooling层,之后连接两部分向量用于预测 |

| Zhang等[40],2019 | 提取全局上下文信息及构建注意力模块 | 设计了一种全局上下文敏感网络,GCNet,来学习全局场景语义;提出了空间感知模块,以关注图像上信息更丰富的区域 |

| Gong等[39],2020 | 提取局部上下文信息 | 对每个ROI挖掘一个自适应的上下文ROI提取上下文特征(定义3倍ROI区域为有效的上下文区域) |

| Chen等[41],2018 | 注意力模块 | 提出了一种两层注意力机制模块,结合了局部和全局信息 |

| Pang等[43],2019 | 注意力模块 | 基于特征金字塔池化构建了一种全局注意力模块 |

| 李红艳等[44],2019 | 注意力模块 | 使用结合空间和通道的注意力机制模块CBAM |

2.1.4 解决样本量少的弱监督学习基于深度学习的目标检测方法需要大量样本进行训练,而获取大量的样本需要很高的人工成本和时间成本.现有研究大多是基于迁移学习[45-47],将基于自然图像的预训练模型进行微调训练后,用于遥感图像目标检测.然而,遥感图像中的目标往往拍摄视角单一,尺度变化大,且所处的背景环境复杂,使得目标的特征表达与自然图像存在较大的差异.因此,仅依靠迁移学习方法的遥感图像目标检测可能得不到较好的检测结果. ...

Weakly supervised target detection in remote sensing images based on transferred deep features and negative bootstrapping

4

2016

... 基于深度学习的目标检测方法需要大量样本进行训练,而获取大量的样本需要很高的人工成本和时间成本.现有研究大多是基于迁移学习[45-47],将基于自然图像的预训练模型进行微调训练后,用于遥感图像目标检测.然而,遥感图像中的目标往往拍摄视角单一,尺度变化大,且所处的背景环境复杂,使得目标的特征表达与自然图像存在较大的差异.因此,仅依靠迁移学习方法的遥感图像目标检测可能得不到较好的检测结果. ...

... 弱监督学习可以使用图像级标注进行迭代学习来扩充训练样本,从而不断提高训练样本质量,大大降低人工标注成本.此外,弱监督学习还可以使用每次训练得到的置信度高、易与正样本混淆且在视觉上和正样本相似的负样本对模型进行迭代训练,有效抑制背景,增强模型的学习能力[45,48-50]. ...

... The object detection methods of limited samples

Table 4| 文献 | 方法 | 特点 |

|---|

| Zhou等[45],2016;Zhong等[46],2018;Dong等[47],2019 | 迁移学习 | 将在大规模自然图像数据集上的训练模型用于遥感图像目标检测,并进行训练微调 |

| Zhu等[18],2020 | 数据增广 | 用生成对抗网络GAN产生新的数据集来训练模型 |

| Han等[48],2015 | 弱监督学习 | 提出了一种基于贝叶斯原理的弱监督学习框架,对弱标注的样本进行训练,通过迭代更新正样本集标签 |

| Zhang等[49],2015 | 弱监督学习 | 通过基于显著性自适应分割和负挖掘得到初始训练样本,然后通过迭代训练逐步细化训练样本 |

| Zhou等[45],2016 | 弱监督学习 | 提出了一种负样本自举的弱监督目标检测框架,基于显著性的自适应分割方法收集初始正样本,通过生成最可能的正样本和视觉上与正样本最相关的负样本来初始化训练样本,然后使用这些样本迭代训练检测器 |

| Zhang等[50],2016 | 弱监督学习 | 首先初始化训练样本,其次通过挖掘的负样本、标记样本以及辅助数据进行迭代训练,更新训练样本 |

2.1.5 多波段遥感图像目标检测目前大多数遥感图像目标检测任务主要针对光学遥感图像,一般包含RGB 3个波段.遥感数据的不同波段包含了丰富的地物信息,不同地物对不同的光谱波长具有不同的吸收率和反射率,以此可以对地物进行有效区分.多波段图像在地物识别上较RGB图像更具优势,因此,如何利用遥感图像多波段信息进行特征学习,也是遥感图像目标检测的研究重点.不同文献的高光谱目标检测方法对比见表5. ...

... [

45],2016

弱监督学习 | 提出了一种负样本自举的弱监督目标检测框架,基于显著性的自适应分割方法收集初始正样本,通过生成最可能的正样本和视觉上与正样本最相关的负样本来初始化训练样本,然后使用这些样本迭代训练检测器 | | Zhang等[50],2016 | 弱监督学习 | 首先初始化训练样本,其次通过挖掘的负样本、标记样本以及辅助数据进行迭代训练,更新训练样本 |

2.1.5 多波段遥感图像目标检测目前大多数遥感图像目标检测任务主要针对光学遥感图像,一般包含RGB 3个波段.遥感数据的不同波段包含了丰富的地物信息,不同地物对不同的光谱波长具有不同的吸收率和反射率,以此可以对地物进行有效区分.多波段图像在地物识别上较RGB图像更具优势,因此,如何利用遥感图像多波段信息进行特征学习,也是遥感图像目标检测的研究重点.不同文献的高光谱目标检测方法对比见表5. ...

Multi-class geospatial object detection based on a position-sensitive balancing framework for high spatial resolution remote sensing imagery

1

2018

... The object detection methods of limited samples

Table 4| 文献 | 方法 | 特点 |

|---|

| Zhou等[45],2016;Zhong等[46],2018;Dong等[47],2019 | 迁移学习 | 将在大规模自然图像数据集上的训练模型用于遥感图像目标检测,并进行训练微调 |

| Zhu等[18],2020 | 数据增广 | 用生成对抗网络GAN产生新的数据集来训练模型 |

| Han等[48],2015 | 弱监督学习 | 提出了一种基于贝叶斯原理的弱监督学习框架,对弱标注的样本进行训练,通过迭代更新正样本集标签 |

| Zhang等[49],2015 | 弱监督学习 | 通过基于显著性自适应分割和负挖掘得到初始训练样本,然后通过迭代训练逐步细化训练样本 |

| Zhou等[45],2016 | 弱监督学习 | 提出了一种负样本自举的弱监督目标检测框架,基于显著性的自适应分割方法收集初始正样本,通过生成最可能的正样本和视觉上与正样本最相关的负样本来初始化训练样本,然后使用这些样本迭代训练检测器 |

| Zhang等[50],2016 | 弱监督学习 | 首先初始化训练样本,其次通过挖掘的负样本、标记样本以及辅助数据进行迭代训练,更新训练样本 |

2.1.5 多波段遥感图像目标检测目前大多数遥感图像目标检测任务主要针对光学遥感图像,一般包含RGB 3个波段.遥感数据的不同波段包含了丰富的地物信息,不同地物对不同的光谱波长具有不同的吸收率和反射率,以此可以对地物进行有效区分.多波段图像在地物识别上较RGB图像更具优势,因此,如何利用遥感图像多波段信息进行特征学习,也是遥感图像目标检测的研究重点.不同文献的高光谱目标检测方法对比见表5. ...

Sig-NMS-based faster R-CNN combining transfer learning for small target detection in VHR optical remote sensing imagery

2

2019

... 基于深度学习的目标检测方法需要大量样本进行训练,而获取大量的样本需要很高的人工成本和时间成本.现有研究大多是基于迁移学习[45-47],将基于自然图像的预训练模型进行微调训练后,用于遥感图像目标检测.然而,遥感图像中的目标往往拍摄视角单一,尺度变化大,且所处的背景环境复杂,使得目标的特征表达与自然图像存在较大的差异.因此,仅依靠迁移学习方法的遥感图像目标检测可能得不到较好的检测结果. ...

... The object detection methods of limited samples

Table 4| 文献 | 方法 | 特点 |

|---|

| Zhou等[45],2016;Zhong等[46],2018;Dong等[47],2019 | 迁移学习 | 将在大规模自然图像数据集上的训练模型用于遥感图像目标检测,并进行训练微调 |

| Zhu等[18],2020 | 数据增广 | 用生成对抗网络GAN产生新的数据集来训练模型 |

| Han等[48],2015 | 弱监督学习 | 提出了一种基于贝叶斯原理的弱监督学习框架,对弱标注的样本进行训练,通过迭代更新正样本集标签 |

| Zhang等[49],2015 | 弱监督学习 | 通过基于显著性自适应分割和负挖掘得到初始训练样本,然后通过迭代训练逐步细化训练样本 |

| Zhou等[45],2016 | 弱监督学习 | 提出了一种负样本自举的弱监督目标检测框架,基于显著性的自适应分割方法收集初始正样本,通过生成最可能的正样本和视觉上与正样本最相关的负样本来初始化训练样本,然后使用这些样本迭代训练检测器 |

| Zhang等[50],2016 | 弱监督学习 | 首先初始化训练样本,其次通过挖掘的负样本、标记样本以及辅助数据进行迭代训练,更新训练样本 |

2.1.5 多波段遥感图像目标检测目前大多数遥感图像目标检测任务主要针对光学遥感图像,一般包含RGB 3个波段.遥感数据的不同波段包含了丰富的地物信息,不同地物对不同的光谱波长具有不同的吸收率和反射率,以此可以对地物进行有效区分.多波段图像在地物识别上较RGB图像更具优势,因此,如何利用遥感图像多波段信息进行特征学习,也是遥感图像目标检测的研究重点.不同文献的高光谱目标检测方法对比见表5. ...

Object detection in optical remote sensing images based on weakly supervised learning and high-level feature learning

2

2015

... 弱监督学习可以使用图像级标注进行迭代学习来扩充训练样本,从而不断提高训练样本质量,大大降低人工标注成本.此外,弱监督学习还可以使用每次训练得到的置信度高、易与正样本混淆且在视觉上和正样本相似的负样本对模型进行迭代训练,有效抑制背景,增强模型的学习能力[45,48-50]. ...

... The object detection methods of limited samples

Table 4| 文献 | 方法 | 特点 |

|---|

| Zhou等[45],2016;Zhong等[46],2018;Dong等[47],2019 | 迁移学习 | 将在大规模自然图像数据集上的训练模型用于遥感图像目标检测,并进行训练微调 |

| Zhu等[18],2020 | 数据增广 | 用生成对抗网络GAN产生新的数据集来训练模型 |

| Han等[48],2015 | 弱监督学习 | 提出了一种基于贝叶斯原理的弱监督学习框架,对弱标注的样本进行训练,通过迭代更新正样本集标签 |

| Zhang等[49],2015 | 弱监督学习 | 通过基于显著性自适应分割和负挖掘得到初始训练样本,然后通过迭代训练逐步细化训练样本 |

| Zhou等[45],2016 | 弱监督学习 | 提出了一种负样本自举的弱监督目标检测框架,基于显著性的自适应分割方法收集初始正样本,通过生成最可能的正样本和视觉上与正样本最相关的负样本来初始化训练样本,然后使用这些样本迭代训练检测器 |

| Zhang等[50],2016 | 弱监督学习 | 首先初始化训练样本,其次通过挖掘的负样本、标记样本以及辅助数据进行迭代训练,更新训练样本 |

2.1.5 多波段遥感图像目标检测目前大多数遥感图像目标检测任务主要针对光学遥感图像,一般包含RGB 3个波段.遥感数据的不同波段包含了丰富的地物信息,不同地物对不同的光谱波长具有不同的吸收率和反射率,以此可以对地物进行有效区分.多波段图像在地物识别上较RGB图像更具优势,因此,如何利用遥感图像多波段信息进行特征学习,也是遥感图像目标检测的研究重点.不同文献的高光谱目标检测方法对比见表5. ...

Weakly supervised learning for target detection in remote sensing images

1

2015

... The object detection methods of limited samples

Table 4| 文献 | 方法 | 特点 |

|---|

| Zhou等[45],2016;Zhong等[46],2018;Dong等[47],2019 | 迁移学习 | 将在大规模自然图像数据集上的训练模型用于遥感图像目标检测,并进行训练微调 |

| Zhu等[18],2020 | 数据增广 | 用生成对抗网络GAN产生新的数据集来训练模型 |

| Han等[48],2015 | 弱监督学习 | 提出了一种基于贝叶斯原理的弱监督学习框架,对弱标注的样本进行训练,通过迭代更新正样本集标签 |

| Zhang等[49],2015 | 弱监督学习 | 通过基于显著性自适应分割和负挖掘得到初始训练样本,然后通过迭代训练逐步细化训练样本 |

| Zhou等[45],2016 | 弱监督学习 | 提出了一种负样本自举的弱监督目标检测框架,基于显著性的自适应分割方法收集初始正样本,通过生成最可能的正样本和视觉上与正样本最相关的负样本来初始化训练样本,然后使用这些样本迭代训练检测器 |

| Zhang等[50],2016 | 弱监督学习 | 首先初始化训练样本,其次通过挖掘的负样本、标记样本以及辅助数据进行迭代训练,更新训练样本 |

2.1.5 多波段遥感图像目标检测目前大多数遥感图像目标检测任务主要针对光学遥感图像,一般包含RGB 3个波段.遥感数据的不同波段包含了丰富的地物信息,不同地物对不同的光谱波长具有不同的吸收率和反射率,以此可以对地物进行有效区分.多波段图像在地物识别上较RGB图像更具优势,因此,如何利用遥感图像多波段信息进行特征学习,也是遥感图像目标检测的研究重点.不同文献的高光谱目标检测方法对比见表5. ...

Weakly supervised learning based on coupled convolutional neural networks for aircraft detection

3

2016

... 弱监督学习可以使用图像级标注进行迭代学习来扩充训练样本,从而不断提高训练样本质量,大大降低人工标注成本.此外,弱监督学习还可以使用每次训练得到的置信度高、易与正样本混淆且在视觉上和正样本相似的负样本对模型进行迭代训练,有效抑制背景,增强模型的学习能力[45,48-50]. ...

... The object detection methods of limited samples

Table 4| 文献 | 方法 | 特点 |

|---|

| Zhou等[45],2016;Zhong等[46],2018;Dong等[47],2019 | 迁移学习 | 将在大规模自然图像数据集上的训练模型用于遥感图像目标检测,并进行训练微调 |

| Zhu等[18],2020 | 数据增广 | 用生成对抗网络GAN产生新的数据集来训练模型 |

| Han等[48],2015 | 弱监督学习 | 提出了一种基于贝叶斯原理的弱监督学习框架,对弱标注的样本进行训练,通过迭代更新正样本集标签 |

| Zhang等[49],2015 | 弱监督学习 | 通过基于显著性自适应分割和负挖掘得到初始训练样本,然后通过迭代训练逐步细化训练样本 |

| Zhou等[45],2016 | 弱监督学习 | 提出了一种负样本自举的弱监督目标检测框架,基于显著性的自适应分割方法收集初始正样本,通过生成最可能的正样本和视觉上与正样本最相关的负样本来初始化训练样本,然后使用这些样本迭代训练检测器 |

| Zhang等[50],2016 | 弱监督学习 | 首先初始化训练样本,其次通过挖掘的负样本、标记样本以及辅助数据进行迭代训练,更新训练样本 |

2.1.5 多波段遥感图像目标检测目前大多数遥感图像目标检测任务主要针对光学遥感图像,一般包含RGB 3个波段.遥感数据的不同波段包含了丰富的地物信息,不同地物对不同的光谱波长具有不同的吸收率和反射率,以此可以对地物进行有效区分.多波段图像在地物识别上较RGB图像更具优势,因此,如何利用遥感图像多波段信息进行特征学习,也是遥感图像目标检测的研究重点.不同文献的高光谱目标检测方法对比见表5. ...

... 部分研究通过构建新的检测框架来解决飞机目标检测中人工标注成本高、缺乏大量优质训练样本等问题.Zhang等[50]构建了一种基于耦合CNN结构的弱监督学习框架,可以从原始图像中自动挖掘和扩充训练数据集,该方法已用于大尺度图像中的飞机目标检测.Yang等[66]基于FCN建立了一个鲁棒性的飞机目标检测网络,利用较少样本进行训练,从而避免人工标记样本耗时耗力,并利用多尺度马尔科夫随机域算法提高了定位精度.然而,该方法不能有效利用GPU能力,存在处理速度上较慢等缺点. ...

Transferred deep learning for anomaly detection in hyperspectral imagery

2

2017

... The object detection methods of hyperspectral images

Table 5| 文献 | 方法 | 特点 |

|---|

| Li等[51],2017 | CNN | 从训练样本中选择像素对来训练CNN,用训练好的CNN衡量测试像素和周围环境的相似度,并对这些相似度值进行平均作为最终测试输出 |

| Cheng等[52],2018 | CNN | 使用CNN来提取高光谱图像深层特征,同时提出了一种基于度量学习的框架来学习判别频谱空间特征,最终在SVM中嵌入一个度量学习正则化项以实现高光谱图像分类 |

| Zhou等[16],2019 | 堆叠自动编码器 | 提出了一个高光谱图像分类框架CDSAE,利用局部Fisher判别正则化和多样性正则化来训练模型 |

| Xie等[17],2020 | 光谱正则化无监督网络 | 基于AE和VAE构建了光谱正则化无监督网络,证明了其在目标检测上表现更好 |

高光谱图像光谱分辨率高,光谱信息丰富,每个像素都呈现连续的光谱曲线,这些光谱信息可以反映地物之间的细微差异,像素可以表达目标的物理属性.相比于可见光、SAR等图像,信息丰富的高光谱图像在遥感图像目标检测中具有突出优势.深度学习模型具备较强的特征学习能力,可以高效地用于海量数据的处理.用深度学习模型充分挖掘高光谱图像的光谱信息和空间信息,可以实现对高光谱图像目标的精准检测.Li等[51]通过利用同类目标像素对之间的相似度以及不同类目标像素之间的差异训练CNN,以挖掘高光谱图像像素信息来进行类别检测.Cheng等[52]利用CNN提取高光谱图像空间特征,并在SVM中嵌入一个度量学习正则化项以学习高光谱图像的光谱和空间特征.Zhou等[16]在堆叠自动编码(Stacked Autoencoder, SAE)的每个隐藏层中加入局部Fisher判别正则化项和多样性正则化项,用于学习低维特征表达,之后用这两种正则化来联合训练特征提取器和分类器,以实现高光谱图像分类.鉴于样本有限,Xie等[17]研究发现无监督学习在高光谱图像目标检测上较监督学习表现更好,相比于自动编码(Auto Encoder, AE)和变分编码(Variational Auto Encoder, VAE)更具优势. ...

... 高光谱图像光谱分辨率高,光谱信息丰富,每个像素都呈现连续的光谱曲线,这些光谱信息可以反映地物之间的细微差异,像素可以表达目标的物理属性.相比于可见光、SAR等图像,信息丰富的高光谱图像在遥感图像目标检测中具有突出优势.深度学习模型具备较强的特征学习能力,可以高效地用于海量数据的处理.用深度学习模型充分挖掘高光谱图像的光谱信息和空间信息,可以实现对高光谱图像目标的精准检测.Li等[51]通过利用同类目标像素对之间的相似度以及不同类目标像素之间的差异训练CNN,以挖掘高光谱图像像素信息来进行类别检测.Cheng等[52]利用CNN提取高光谱图像空间特征,并在SVM中嵌入一个度量学习正则化项以学习高光谱图像的光谱和空间特征.Zhou等[16]在堆叠自动编码(Stacked Autoencoder, SAE)的每个隐藏层中加入局部Fisher判别正则化项和多样性正则化项,用于学习低维特征表达,之后用这两种正则化来联合训练特征提取器和分类器,以实现高光谱图像分类.鉴于样本有限,Xie等[17]研究发现无监督学习在高光谱图像目标检测上较监督学习表现更好,相比于自动编码(Auto Encoder, AE)和变分编码(Variational Auto Encoder, VAE)更具优势. ...

Exploring hierarchical convolutional features for hyperspectral image classification

2

2018

... The object detection methods of hyperspectral images

Table 5| 文献 | 方法 | 特点 |

|---|

| Li等[51],2017 | CNN | 从训练样本中选择像素对来训练CNN,用训练好的CNN衡量测试像素和周围环境的相似度,并对这些相似度值进行平均作为最终测试输出 |

| Cheng等[52],2018 | CNN | 使用CNN来提取高光谱图像深层特征,同时提出了一种基于度量学习的框架来学习判别频谱空间特征,最终在SVM中嵌入一个度量学习正则化项以实现高光谱图像分类 |

| Zhou等[16],2019 | 堆叠自动编码器 | 提出了一个高光谱图像分类框架CDSAE,利用局部Fisher判别正则化和多样性正则化来训练模型 |

| Xie等[17],2020 | 光谱正则化无监督网络 | 基于AE和VAE构建了光谱正则化无监督网络,证明了其在目标检测上表现更好 |

高光谱图像光谱分辨率高,光谱信息丰富,每个像素都呈现连续的光谱曲线,这些光谱信息可以反映地物之间的细微差异,像素可以表达目标的物理属性.相比于可见光、SAR等图像,信息丰富的高光谱图像在遥感图像目标检测中具有突出优势.深度学习模型具备较强的特征学习能力,可以高效地用于海量数据的处理.用深度学习模型充分挖掘高光谱图像的光谱信息和空间信息,可以实现对高光谱图像目标的精准检测.Li等[51]通过利用同类目标像素对之间的相似度以及不同类目标像素之间的差异训练CNN,以挖掘高光谱图像像素信息来进行类别检测.Cheng等[52]利用CNN提取高光谱图像空间特征,并在SVM中嵌入一个度量学习正则化项以学习高光谱图像的光谱和空间特征.Zhou等[16]在堆叠自动编码(Stacked Autoencoder, SAE)的每个隐藏层中加入局部Fisher判别正则化项和多样性正则化项,用于学习低维特征表达,之后用这两种正则化来联合训练特征提取器和分类器,以实现高光谱图像分类.鉴于样本有限,Xie等[17]研究发现无监督学习在高光谱图像目标检测上较监督学习表现更好,相比于自动编码(Auto Encoder, AE)和变分编码(Variational Auto Encoder, VAE)更具优势. ...

... 高光谱图像光谱分辨率高,光谱信息丰富,每个像素都呈现连续的光谱曲线,这些光谱信息可以反映地物之间的细微差异,像素可以表达目标的物理属性.相比于可见光、SAR等图像,信息丰富的高光谱图像在遥感图像目标检测中具有突出优势.深度学习模型具备较强的特征学习能力,可以高效地用于海量数据的处理.用深度学习模型充分挖掘高光谱图像的光谱信息和空间信息,可以实现对高光谱图像目标的精准检测.Li等[51]通过利用同类目标像素对之间的相似度以及不同类目标像素之间的差异训练CNN,以挖掘高光谱图像像素信息来进行类别检测.Cheng等[52]利用CNN提取高光谱图像空间特征,并在SVM中嵌入一个度量学习正则化项以学习高光谱图像的光谱和空间特征.Zhou等[16]在堆叠自动编码(Stacked Autoencoder, SAE)的每个隐藏层中加入局部Fisher判别正则化项和多样性正则化项,用于学习低维特征表达,之后用这两种正则化来联合训练特征提取器和分类器,以实现高光谱图像分类.鉴于样本有限,Xie等[17]研究发现无监督学习在高光谱图像目标检测上较监督学习表现更好,相比于自动编码(Auto Encoder, AE)和变分编码(Variational Auto Encoder, VAE)更具优势. ...

Convolutional neural network with data augmentation for SAR target recognition

2

2016

... 合成孔径雷达(SAR)是一种主动式微波雷达成像系统,具有全天时全天候检测特点,不仅可以穿透地表获取被掩盖的目标,还可以得到精确的目标位置,在机场管理、海洋、农业以及自然灾害实时监测等方面具有重要应用.随着深度学习技术大力发展,深度卷积网络在图像识别和目标检测中表现优越,基于深度学习的SAR图像目标检测研究成果越来越多.SAR图像目标检测对象大多数为船舶[53-60]、机场[61]等,这类目标在SAR图像中有较强的散射特性,具有明显的视觉特征,更易于识别.针对SAR图像的目标检测方法对比见表6.利用卷积神经网络学习高分辨率SAR图像中目标特征,以实现船舶、机场等目标的自动检测,这在遥感目标检测领域中具有广阔的应用前景. ...

... The object detection methods of SAR images

Table 6| 文献 | 方法 | 特点 |

|---|

| Ding等[53],2016 | CNN | 结合卷积神经网络和三种数据增广方法,实现对SAR图像目标自动识别 |

| Liu等[54],2017 | CNN | 提出了基于海陆分割的CNN框架,结合CNN、显著性计算和角点特性实现SAR图像船舶检测 |

| Wang等[55],2018 | SSD | 结合迁移学习和SSD模型提高SAR图像检测精度,降低误报率 |

| Zhao等[56],2018 | 耦合CNN | 以耦合CNN作为特征提取网络,提出了基于脉冲余弦变换的视觉注意力方法,从频域角度进行船舶识别 |

| Fan等[57],2019 | 分割模型 | 基于全卷积网络提出了一种针对极化SAR图像的船舶分割模型,有效减少海杂波和SAR图像模糊影响 |

| Lin等[58],2019 | 注意力机制 | 结合SENet和FasterR-CNN减少船舶误检、漏检情况 |

| Chang等[59],2019 | YOLOv2 | 基于YOLOv2提出了一种层数更少的新框架,更好地减少计算量和模型检测时间 |

| Wei等[60],2020 | 高分辨率金字塔网络 | 提出了一种高分辨率特征金字塔模型用于提取SAR图像中高层和低层特征,并采用缓和非极大抑制方法(Soft-NMS)提高密集船舶目标检测性能 |

| Chen等[61],2020 | 双注意力机制 | 提出了一种多尺度双注意目标检测网络用于机场提取 |

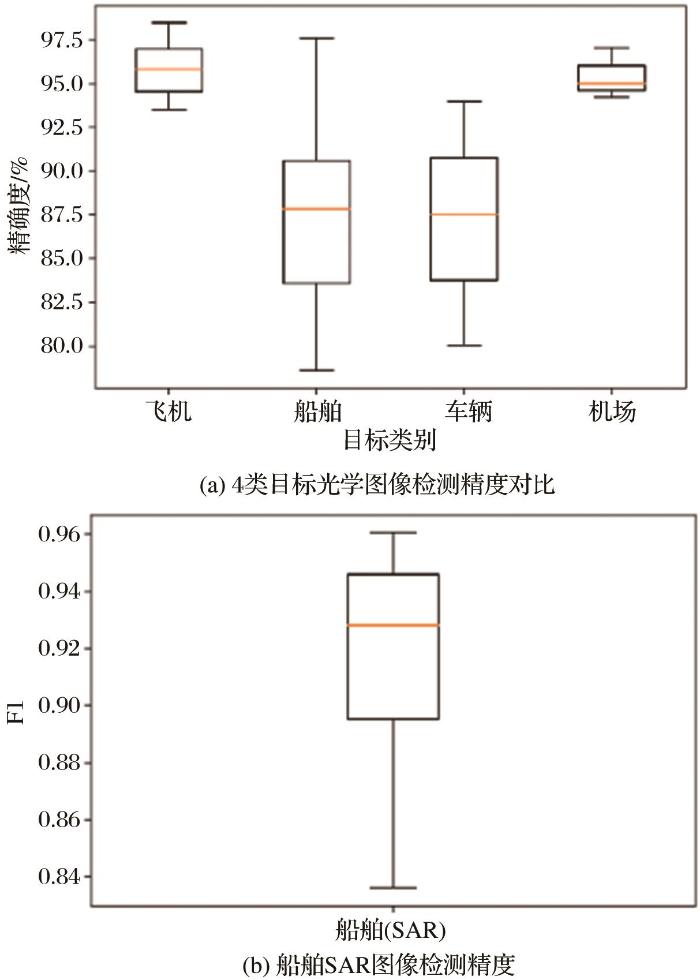

2.2 遥感图像典型目标检测应用本节总结了深度学习方法在单目标检测如飞机、船舶和车辆等,以及复杂目标检测如机场等的研究进展,这类典型的目标检测研究具有重要的应用价值. ...

SAR Ship Detection using sea-land segmentation-based donvolutional neural network

1

2017

... The object detection methods of SAR images

Table 6| 文献 | 方法 | 特点 |

|---|

| Ding等[53],2016 | CNN | 结合卷积神经网络和三种数据增广方法,实现对SAR图像目标自动识别 |

| Liu等[54],2017 | CNN | 提出了基于海陆分割的CNN框架,结合CNN、显著性计算和角点特性实现SAR图像船舶检测 |

| Wang等[55],2018 | SSD | 结合迁移学习和SSD模型提高SAR图像检测精度,降低误报率 |

| Zhao等[56],2018 | 耦合CNN | 以耦合CNN作为特征提取网络,提出了基于脉冲余弦变换的视觉注意力方法,从频域角度进行船舶识别 |

| Fan等[57],2019 | 分割模型 | 基于全卷积网络提出了一种针对极化SAR图像的船舶分割模型,有效减少海杂波和SAR图像模糊影响 |

| Lin等[58],2019 | 注意力机制 | 结合SENet和FasterR-CNN减少船舶误检、漏检情况 |

| Chang等[59],2019 | YOLOv2 | 基于YOLOv2提出了一种层数更少的新框架,更好地减少计算量和模型检测时间 |

| Wei等[60],2020 | 高分辨率金字塔网络 | 提出了一种高分辨率特征金字塔模型用于提取SAR图像中高层和低层特征,并采用缓和非极大抑制方法(Soft-NMS)提高密集船舶目标检测性能 |

| Chen等[61],2020 | 双注意力机制 | 提出了一种多尺度双注意目标检测网络用于机场提取 |

2.2 遥感图像典型目标检测应用本节总结了深度学习方法在单目标检测如飞机、船舶和车辆等,以及复杂目标检测如机场等的研究进展,这类典型的目标检测研究具有重要的应用价值. ...

Combining a single shot multibox detector with transfer learning for ship detection using sentinel-1 SAR images

1

2018

... The object detection methods of SAR images

Table 6| 文献 | 方法 | 特点 |

|---|

| Ding等[53],2016 | CNN | 结合卷积神经网络和三种数据增广方法,实现对SAR图像目标自动识别 |

| Liu等[54],2017 | CNN | 提出了基于海陆分割的CNN框架,结合CNN、显著性计算和角点特性实现SAR图像船舶检测 |

| Wang等[55],2018 | SSD | 结合迁移学习和SSD模型提高SAR图像检测精度,降低误报率 |

| Zhao等[56],2018 | 耦合CNN | 以耦合CNN作为特征提取网络,提出了基于脉冲余弦变换的视觉注意力方法,从频域角度进行船舶识别 |

| Fan等[57],2019 | 分割模型 | 基于全卷积网络提出了一种针对极化SAR图像的船舶分割模型,有效减少海杂波和SAR图像模糊影响 |

| Lin等[58],2019 | 注意力机制 | 结合SENet和FasterR-CNN减少船舶误检、漏检情况 |

| Chang等[59],2019 | YOLOv2 | 基于YOLOv2提出了一种层数更少的新框架,更好地减少计算量和模型检测时间 |

| Wei等[60],2020 | 高分辨率金字塔网络 | 提出了一种高分辨率特征金字塔模型用于提取SAR图像中高层和低层特征,并采用缓和非极大抑制方法(Soft-NMS)提高密集船舶目标检测性能 |

| Chen等[61],2020 | 双注意力机制 | 提出了一种多尺度双注意目标检测网络用于机场提取 |

2.2 遥感图像典型目标检测应用本节总结了深度学习方法在单目标检测如飞机、船舶和车辆等,以及复杂目标检测如机场等的研究进展,这类典型的目标检测研究具有重要的应用价值. ...

A cascade coupled convolutional neural network guided visual attention method for ship detection from SAR images

2

2018

... The object detection methods of SAR images

Table 6| 文献 | 方法 | 特点 |

|---|

| Ding等[53],2016 | CNN | 结合卷积神经网络和三种数据增广方法,实现对SAR图像目标自动识别 |

| Liu等[54],2017 | CNN | 提出了基于海陆分割的CNN框架,结合CNN、显著性计算和角点特性实现SAR图像船舶检测 |

| Wang等[55],2018 | SSD | 结合迁移学习和SSD模型提高SAR图像检测精度,降低误报率 |

| Zhao等[56],2018 | 耦合CNN | 以耦合CNN作为特征提取网络,提出了基于脉冲余弦变换的视觉注意力方法,从频域角度进行船舶识别 |

| Fan等[57],2019 | 分割模型 | 基于全卷积网络提出了一种针对极化SAR图像的船舶分割模型,有效减少海杂波和SAR图像模糊影响 |

| Lin等[58],2019 | 注意力机制 | 结合SENet和FasterR-CNN减少船舶误检、漏检情况 |

| Chang等[59],2019 | YOLOv2 | 基于YOLOv2提出了一种层数更少的新框架,更好地减少计算量和模型检测时间 |

| Wei等[60],2020 | 高分辨率金字塔网络 | 提出了一种高分辨率特征金字塔模型用于提取SAR图像中高层和低层特征,并采用缓和非极大抑制方法(Soft-NMS)提高密集船舶目标检测性能 |

| Chen等[61],2020 | 双注意力机制 | 提出了一种多尺度双注意目标检测网络用于机场提取 |

2.2 遥感图像典型目标检测应用本节总结了深度学习方法在单目标检测如飞机、船舶和车辆等,以及复杂目标检测如机场等的研究进展,这类典型的目标检测研究具有重要的应用价值. ...

... 针对近海船舶目标检测,Lin等[67]采用了任务分割方法,将任务划分为两条路径,浅层路径用于精确定位目标,深层路径用于生成注意力图,结合两分支的输出可以得到高召回率和高精度的检测结果.为了解决近海岸小目标船舶检测问题,Kang等[68]提出了一个结合目标特征和像素的方法,基于Faster R-CNN模型生成建议区并对目标进行分类,对结构模糊的小目标采用恒定虚警率(CFAR)算法进行检测.Zhao等[56]提出了一种级联共轭卷积模型,将学习空间域的CNN模型与频域视觉注意模型相结合,有效降低了漏检率和虚警率.Lin等[58]提出了一种基于Squeeze and Excitation(SE)的Faster R-CNN的检测模型提高了SAR图像船舶检测精度. ...

Ship detection using a fully convolutional network with compact polarimetric SAR images

1

2019

... The object detection methods of SAR images

Table 6| 文献 | 方法 | 特点 |

|---|

| Ding等[53],2016 | CNN | 结合卷积神经网络和三种数据增广方法,实现对SAR图像目标自动识别 |

| Liu等[54],2017 | CNN | 提出了基于海陆分割的CNN框架,结合CNN、显著性计算和角点特性实现SAR图像船舶检测 |

| Wang等[55],2018 | SSD | 结合迁移学习和SSD模型提高SAR图像检测精度,降低误报率 |

| Zhao等[56],2018 | 耦合CNN | 以耦合CNN作为特征提取网络,提出了基于脉冲余弦变换的视觉注意力方法,从频域角度进行船舶识别 |

| Fan等[57],2019 | 分割模型 | 基于全卷积网络提出了一种针对极化SAR图像的船舶分割模型,有效减少海杂波和SAR图像模糊影响 |

| Lin等[58],2019 | 注意力机制 | 结合SENet和FasterR-CNN减少船舶误检、漏检情况 |

| Chang等[59],2019 | YOLOv2 | 基于YOLOv2提出了一种层数更少的新框架,更好地减少计算量和模型检测时间 |

| Wei等[60],2020 | 高分辨率金字塔网络 | 提出了一种高分辨率特征金字塔模型用于提取SAR图像中高层和低层特征,并采用缓和非极大抑制方法(Soft-NMS)提高密集船舶目标检测性能 |

| Chen等[61],2020 | 双注意力机制 | 提出了一种多尺度双注意目标检测网络用于机场提取 |

2.2 遥感图像典型目标检测应用本节总结了深度学习方法在单目标检测如飞机、船舶和车辆等,以及复杂目标检测如机场等的研究进展,这类典型的目标检测研究具有重要的应用价值. ...

Squeeze and excitation rank faster R-CNN for ship detection in SAR images

2

2019

... The object detection methods of SAR images

Table 6| 文献 | 方法 | 特点 |

|---|

| Ding等[53],2016 | CNN | 结合卷积神经网络和三种数据增广方法,实现对SAR图像目标自动识别 |

| Liu等[54],2017 | CNN | 提出了基于海陆分割的CNN框架,结合CNN、显著性计算和角点特性实现SAR图像船舶检测 |

| Wang等[55],2018 | SSD | 结合迁移学习和SSD模型提高SAR图像检测精度,降低误报率 |

| Zhao等[56],2018 | 耦合CNN | 以耦合CNN作为特征提取网络,提出了基于脉冲余弦变换的视觉注意力方法,从频域角度进行船舶识别 |

| Fan等[57],2019 | 分割模型 | 基于全卷积网络提出了一种针对极化SAR图像的船舶分割模型,有效减少海杂波和SAR图像模糊影响 |

| Lin等[58],2019 | 注意力机制 | 结合SENet和FasterR-CNN减少船舶误检、漏检情况 |

| Chang等[59],2019 | YOLOv2 | 基于YOLOv2提出了一种层数更少的新框架,更好地减少计算量和模型检测时间 |

| Wei等[60],2020 | 高分辨率金字塔网络 | 提出了一种高分辨率特征金字塔模型用于提取SAR图像中高层和低层特征,并采用缓和非极大抑制方法(Soft-NMS)提高密集船舶目标检测性能 |

| Chen等[61],2020 | 双注意力机制 | 提出了一种多尺度双注意目标检测网络用于机场提取 |

2.2 遥感图像典型目标检测应用本节总结了深度学习方法在单目标检测如飞机、船舶和车辆等,以及复杂目标检测如机场等的研究进展,这类典型的目标检测研究具有重要的应用价值. ...

... 针对近海船舶目标检测,Lin等[67]采用了任务分割方法,将任务划分为两条路径,浅层路径用于精确定位目标,深层路径用于生成注意力图,结合两分支的输出可以得到高召回率和高精度的检测结果.为了解决近海岸小目标船舶检测问题,Kang等[68]提出了一个结合目标特征和像素的方法,基于Faster R-CNN模型生成建议区并对目标进行分类,对结构模糊的小目标采用恒定虚警率(CFAR)算法进行检测.Zhao等[56]提出了一种级联共轭卷积模型,将学习空间域的CNN模型与频域视觉注意模型相结合,有效降低了漏检率和虚警率.Lin等[58]提出了一种基于Squeeze and Excitation(SE)的Faster R-CNN的检测模型提高了SAR图像船舶检测精度. ...

Multi-scale proposal generation for ship detection in SAR images

1

2019

... The object detection methods of SAR images

Table 6| 文献 | 方法 | 特点 |

|---|

| Ding等[53],2016 | CNN | 结合卷积神经网络和三种数据增广方法,实现对SAR图像目标自动识别 |

| Liu等[54],2017 | CNN | 提出了基于海陆分割的CNN框架,结合CNN、显著性计算和角点特性实现SAR图像船舶检测 |

| Wang等[55],2018 | SSD | 结合迁移学习和SSD模型提高SAR图像检测精度,降低误报率 |

| Zhao等[56],2018 | 耦合CNN | 以耦合CNN作为特征提取网络,提出了基于脉冲余弦变换的视觉注意力方法,从频域角度进行船舶识别 |

| Fan等[57],2019 | 分割模型 | 基于全卷积网络提出了一种针对极化SAR图像的船舶分割模型,有效减少海杂波和SAR图像模糊影响 |

| Lin等[58],2019 | 注意力机制 | 结合SENet和FasterR-CNN减少船舶误检、漏检情况 |

| Chang等[59],2019 | YOLOv2 | 基于YOLOv2提出了一种层数更少的新框架,更好地减少计算量和模型检测时间 |

| Wei等[60],2020 | 高分辨率金字塔网络 | 提出了一种高分辨率特征金字塔模型用于提取SAR图像中高层和低层特征,并采用缓和非极大抑制方法(Soft-NMS)提高密集船舶目标检测性能 |

| Chen等[61],2020 | 双注意力机制 | 提出了一种多尺度双注意目标检测网络用于机场提取 |

2.2 遥感图像典型目标检测应用本节总结了深度学习方法在单目标检测如飞机、船舶和车辆等,以及复杂目标检测如机场等的研究进展,这类典型的目标检测研究具有重要的应用价值. ...

Precise and robust ship detection for high-resolution SAR imagery rased on HR-SDNet

3

2020

... 合成孔径雷达(SAR)是一种主动式微波雷达成像系统,具有全天时全天候检测特点,不仅可以穿透地表获取被掩盖的目标,还可以得到精确的目标位置,在机场管理、海洋、农业以及自然灾害实时监测等方面具有重要应用.随着深度学习技术大力发展,深度卷积网络在图像识别和目标检测中表现优越,基于深度学习的SAR图像目标检测研究成果越来越多.SAR图像目标检测对象大多数为船舶[53-60]、机场[61]等,这类目标在SAR图像中有较强的散射特性,具有明显的视觉特征,更易于识别.针对SAR图像的目标检测方法对比见表6.利用卷积神经网络学习高分辨率SAR图像中目标特征,以实现船舶、机场等目标的自动检测,这在遥感目标检测领域中具有广阔的应用前景. ...

... The object detection methods of SAR images

Table 6| 文献 | 方法 | 特点 |

|---|

| Ding等[53],2016 | CNN | 结合卷积神经网络和三种数据增广方法,实现对SAR图像目标自动识别 |

| Liu等[54],2017 | CNN | 提出了基于海陆分割的CNN框架,结合CNN、显著性计算和角点特性实现SAR图像船舶检测 |

| Wang等[55],2018 | SSD | 结合迁移学习和SSD模型提高SAR图像检测精度,降低误报率 |

| Zhao等[56],2018 | 耦合CNN | 以耦合CNN作为特征提取网络,提出了基于脉冲余弦变换的视觉注意力方法,从频域角度进行船舶识别 |

| Fan等[57],2019 | 分割模型 | 基于全卷积网络提出了一种针对极化SAR图像的船舶分割模型,有效减少海杂波和SAR图像模糊影响 |

| Lin等[58],2019 | 注意力机制 | 结合SENet和FasterR-CNN减少船舶误检、漏检情况 |

| Chang等[59],2019 | YOLOv2 | 基于YOLOv2提出了一种层数更少的新框架,更好地减少计算量和模型检测时间 |

| Wei等[60],2020 | 高分辨率金字塔网络 | 提出了一种高分辨率特征金字塔模型用于提取SAR图像中高层和低层特征,并采用缓和非极大抑制方法(Soft-NMS)提高密集船舶目标检测性能 |

| Chen等[61],2020 | 双注意力机制 | 提出了一种多尺度双注意目标检测网络用于机场提取 |

2.2 遥感图像典型目标检测应用本节总结了深度学习方法在单目标检测如飞机、船舶和车辆等,以及复杂目标检测如机场等的研究进展,这类典型的目标检测研究具有重要的应用价值. ...

... 为了提高在近海和远海场景的高分辨率SAR图像检测精度,Wei等[60]提出了一个高分辨率特征金字塔结构,充分利用了高分辨率和低分辨率的特征映射.同时利用级联结构提高了检测精度.为实现复杂背景下多目标、多尺度船舶目标检测,Chen等[69]提出用K-means聚类算法来优化FPN模型.为了实现大尺度场景下的船舶目标检测,Li等[70]提出了一种高分辨率遥感图像船舶识别方法HSF-Net,在Faster R-CNN模型基础上加入分层选择过滤层(HSF),可以获取更好的多尺度船舶特征.此外,HSF-Net在大尺度光学遥感图像上对静止和运动的船只进行了检测,背景为海洋、岛屿、港口和城市等多场景,图像分辨率为0.3~5 m,最终得到精确率为89.4%,召回率为98.3%. ...

A New framework for automatic airports extraction from SAR images using multi-level dual attention mechanism

3

2020

... 合成孔径雷达(SAR)是一种主动式微波雷达成像系统,具有全天时全天候检测特点,不仅可以穿透地表获取被掩盖的目标,还可以得到精确的目标位置,在机场管理、海洋、农业以及自然灾害实时监测等方面具有重要应用.随着深度学习技术大力发展,深度卷积网络在图像识别和目标检测中表现优越,基于深度学习的SAR图像目标检测研究成果越来越多.SAR图像目标检测对象大多数为船舶[53-60]、机场[61]等,这类目标在SAR图像中有较强的散射特性,具有明显的视觉特征,更易于识别.针对SAR图像的目标检测方法对比见表6.利用卷积神经网络学习高分辨率SAR图像中目标特征,以实现船舶、机场等目标的自动检测,这在遥感目标检测领域中具有广阔的应用前景. ...

... The object detection methods of SAR images

Table 6| 文献 | 方法 | 特点 |

|---|

| Ding等[53],2016 | CNN | 结合卷积神经网络和三种数据增广方法,实现对SAR图像目标自动识别 |

| Liu等[54],2017 | CNN | 提出了基于海陆分割的CNN框架,结合CNN、显著性计算和角点特性实现SAR图像船舶检测 |

| Wang等[55],2018 | SSD | 结合迁移学习和SSD模型提高SAR图像检测精度,降低误报率 |

| Zhao等[56],2018 | 耦合CNN | 以耦合CNN作为特征提取网络,提出了基于脉冲余弦变换的视觉注意力方法,从频域角度进行船舶识别 |

| Fan等[57],2019 | 分割模型 | 基于全卷积网络提出了一种针对极化SAR图像的船舶分割模型,有效减少海杂波和SAR图像模糊影响 |

| Lin等[58],2019 | 注意力机制 | 结合SENet和FasterR-CNN减少船舶误检、漏检情况 |

| Chang等[59],2019 | YOLOv2 | 基于YOLOv2提出了一种层数更少的新框架,更好地减少计算量和模型检测时间 |

| Wei等[60],2020 | 高分辨率金字塔网络 | 提出了一种高分辨率特征金字塔模型用于提取SAR图像中高层和低层特征,并采用缓和非极大抑制方法(Soft-NMS)提高密集船舶目标检测性能 |

| Chen等[61],2020 | 双注意力机制 | 提出了一种多尺度双注意目标检测网络用于机场提取 |

2.2 遥感图像典型目标检测应用本节总结了深度学习方法在单目标检测如飞机、船舶和车辆等,以及复杂目标检测如机场等的研究进展,这类典型的目标检测研究具有重要的应用价值. ...

... SAR图像中,机场中的跑道较普通的水泥地面表现更暗,而机场中的建筑物、飞机等具有较强的散射特性,表现更亮,所以基于SAR图像的机场目标检测具备一定的优势[61]. ...

Aircraft detection in remote sensing images based on a deep residual network and super-vector coding

1

2018

... 针对飞机目标检测中的弱小目标表征能力不足等问题,现有研究大多使用多尺度特征融合的方法[20,62-63],以提高小目标的检测能力.大尺度遥感图像在分割预处理时,容易丢失较小的飞机目标,Chen等[64]提出了一种端到端的飞机目标检测算法,在输入层前和输出层后分别加入MultiBlock层和MapBlock层,将输入图像调整尺寸为均匀大小,最后将输出的检测结果图映射与输入图尺寸一致.此外,大尺度下小目标特征不突出,容易与非目标类别混淆,通过在卷积网络中加入注意力模块[43]或者引入空洞残差进行多尺度特征融合[65],捕捉目标的上下文信息,从而提高模型的特征表达能力. ...

ORSIm detector: A novel object detection framework in optical remote sensing imagery using spatial-frequency channel features

1

2019

... 针对飞机目标检测中的弱小目标表征能力不足等问题,现有研究大多使用多尺度特征融合的方法[20,62-63],以提高小目标的检测能力.大尺度遥感图像在分割预处理时,容易丢失较小的飞机目标,Chen等[64]提出了一种端到端的飞机目标检测算法,在输入层前和输出层后分别加入MultiBlock层和MapBlock层,将输入图像调整尺寸为均匀大小,最后将输出的检测结果图映射与输入图尺寸一致.此外,大尺度下小目标特征不突出,容易与非目标类别混淆,通过在卷积网络中加入注意力模块[43]或者引入空洞残差进行多尺度特征融合[65],捕捉目标的上下文信息,从而提高模型的特征表达能力. ...

End-to-End airplane detection using transfer learning in remote sensing images

1

2018

... 针对飞机目标检测中的弱小目标表征能力不足等问题,现有研究大多使用多尺度特征融合的方法[20,62-63],以提高小目标的检测能力.大尺度遥感图像在分割预处理时,容易丢失较小的飞机目标,Chen等[64]提出了一种端到端的飞机目标检测算法,在输入层前和输出层后分别加入MultiBlock层和MapBlock层,将输入图像调整尺寸为均匀大小,最后将输出的检测结果图映射与输入图尺寸一致.此外,大尺度下小目标特征不突出,容易与非目标类别混淆,通过在卷积网络中加入注意力模块[43]或者引入空洞残差进行多尺度特征融合[65],捕捉目标的上下文信息,从而提高模型的特征表达能力. ...

Aircraft detection in remote sensing image based on optimized Faster-RCNN

1

2021

... 针对飞机目标检测中的弱小目标表征能力不足等问题,现有研究大多使用多尺度特征融合的方法[20,62-63],以提高小目标的检测能力.大尺度遥感图像在分割预处理时,容易丢失较小的飞机目标,Chen等[64]提出了一种端到端的飞机目标检测算法,在输入层前和输出层后分别加入MultiBlock层和MapBlock层,将输入图像调整尺寸为均匀大小,最后将输出的检测结果图映射与输入图尺寸一致.此外,大尺度下小目标特征不突出,容易与非目标类别混淆,通过在卷积网络中加入注意力模块[43]或者引入空洞残差进行多尺度特征融合[65],捕捉目标的上下文信息,从而提高模型的特征表达能力. ...

M-FCN: Effective fully convolutional network-based airplane detection framework

1

2017

... 部分研究通过构建新的检测框架来解决飞机目标检测中人工标注成本高、缺乏大量优质训练样本等问题.Zhang等[50]构建了一种基于耦合CNN结构的弱监督学习框架,可以从原始图像中自动挖掘和扩充训练数据集,该方法已用于大尺度图像中的飞机目标检测.Yang等[66]基于FCN建立了一个鲁棒性的飞机目标检测网络,利用较少样本进行训练,从而避免人工标记样本耗时耗力,并利用多尺度马尔科夫随机域算法提高了定位精度.然而,该方法不能有效利用GPU能力,存在处理速度上较慢等缺点. ...

Fully convolutional network with task partitioning for inshore ship detection in optical remote sensing Ima-ges

1

2017

... 针对近海船舶目标检测,Lin等[67]采用了任务分割方法,将任务划分为两条路径,浅层路径用于精确定位目标,深层路径用于生成注意力图,结合两分支的输出可以得到高召回率和高精度的检测结果.为了解决近海岸小目标船舶检测问题,Kang等[68]提出了一个结合目标特征和像素的方法,基于Faster R-CNN模型生成建议区并对目标进行分类,对结构模糊的小目标采用恒定虚警率(CFAR)算法进行检测.Zhao等[56]提出了一种级联共轭卷积模型,将学习空间域的CNN模型与频域视觉注意模型相结合,有效降低了漏检率和虚警率.Lin等[58]提出了一种基于Squeeze and Excitation(SE)的Faster R-CNN的检测模型提高了SAR图像船舶检测精度. ...

A modified faster R-CNN based on CFAR algorithm for SAR ship detection

1

2017

... 针对近海船舶目标检测,Lin等[67]采用了任务分割方法,将任务划分为两条路径,浅层路径用于精确定位目标,深层路径用于生成注意力图,结合两分支的输出可以得到高召回率和高精度的检测结果.为了解决近海岸小目标船舶检测问题,Kang等[68]提出了一个结合目标特征和像素的方法,基于Faster R-CNN模型生成建议区并对目标进行分类,对结构模糊的小目标采用恒定虚警率(CFAR)算法进行检测.Zhao等[56]提出了一种级联共轭卷积模型,将学习空间域的CNN模型与频域视觉注意模型相结合,有效降低了漏检率和虚警率.Lin等[58]提出了一种基于Squeeze and Excitation(SE)的Faster R-CNN的检测模型提高了SAR图像船舶检测精度. ...

Detection of small ship objects using anchor boxes cluster and feature pyramid network model for SAR imagery

1

2020

... 为了提高在近海和远海场景的高分辨率SAR图像检测精度,Wei等[60]提出了一个高分辨率特征金字塔结构,充分利用了高分辨率和低分辨率的特征映射.同时利用级联结构提高了检测精度.为实现复杂背景下多目标、多尺度船舶目标检测,Chen等[69]提出用K-means聚类算法来优化FPN模型.为了实现大尺度场景下的船舶目标检测,Li等[70]提出了一种高分辨率遥感图像船舶识别方法HSF-Net,在Faster R-CNN模型基础上加入分层选择过滤层(HSF),可以获取更好的多尺度船舶特征.此外,HSF-Net在大尺度光学遥感图像上对静止和运动的船只进行了检测,背景为海洋、岛屿、港口和城市等多场景,图像分辨率为0.3~5 m,最终得到精确率为89.4%,召回率为98.3%. ...

HSF-Net: Multiscale deep feature embedding for ship detection in optical remote sensing imagery

1

2018

... 为了提高在近海和远海场景的高分辨率SAR图像检测精度,Wei等[60]提出了一个高分辨率特征金字塔结构,充分利用了高分辨率和低分辨率的特征映射.同时利用级联结构提高了检测精度.为实现复杂背景下多目标、多尺度船舶目标检测,Chen等[69]提出用K-means聚类算法来优化FPN模型.为了实现大尺度场景下的船舶目标检测,Li等[70]提出了一种高分辨率遥感图像船舶识别方法HSF-Net,在Faster R-CNN模型基础上加入分层选择过滤层(HSF),可以获取更好的多尺度船舶特征.此外,HSF-Net在大尺度光学遥感图像上对静止和运动的船只进行了检测,背景为海洋、岛屿、港口和城市等多场景,图像分辨率为0.3~5 m,最终得到精确率为89.4%,召回率为98.3%. ...

Ship rotated bounding box space for ship extraction from high-resolution optical satellite images with complex backgrounds

1

2016

... 为了解决靠岸船舶目标检测密集排列、背景复杂等问题,很多研究使用旋转包围框标记船舶样本[21,32-33,71-72],尽可能产生包含更多正样本信息的建议区域,避免复杂背景的干扰,同时这些方法通过构建旋转区域建议网络,来适应不同方向的船舶目标检测. ...

Automatic ship detection in remote sensing images from Google Earth of complex scenes based on multiscale rotation dense feature Pyramid networks

1

2018

... 为了解决靠岸船舶目标检测密集排列、背景复杂等问题,很多研究使用旋转包围框标记船舶样本[21,32-33,71-72],尽可能产生包含更多正样本信息的建议区域,避免复杂背景的干扰,同时这些方法通过构建旋转区域建议网络,来适应不同方向的船舶目标检测. ...

Toward fast and accurate vehicle detection in aerial images using coupled region-based convolutional neural networks

1

2017

... 航空影像中的车辆具有多尺度、多旋转角度和场景复杂等特点,这使得车辆的检测定位更具挑战性.Deng等[73]构建了一种基于超特征映射的目标定位框架AVPN,可以有效地提取小目标特征,实时准确生成车辆建议区,此外还设计了车辆属性学习网络来提取车辆位置.Yang等[74]在Faster R-CNN基础上,构建了一种多视角卷积神经网络Multi-PerNet用于车辆目标检测,通过使用不同尺寸的卷积核提取具有不同感受野的特征图,解决了因缺少目标特征而导致车辆目标检测精度低的问题.Mandal等[75]构建了一种多尺度残差块结构,以获得低层更详细的目标信息,解决了航拍图像中车辆较小、拥挤等问题,同时提高了检测效率. ...

Vehicle object detection in remote sensing imagery based on multi-perspective convolutional neural network

1

2018

... 航空影像中的车辆具有多尺度、多旋转角度和场景复杂等特点,这使得车辆的检测定位更具挑战性.Deng等[73]构建了一种基于超特征映射的目标定位框架AVPN,可以有效地提取小目标特征,实时准确生成车辆建议区,此外还设计了车辆属性学习网络来提取车辆位置.Yang等[74]在Faster R-CNN基础上,构建了一种多视角卷积神经网络Multi-PerNet用于车辆目标检测,通过使用不同尺寸的卷积核提取具有不同感受野的特征图,解决了因缺少目标特征而导致车辆目标检测精度低的问题.Mandal等[75]构建了一种多尺度残差块结构,以获得低层更详细的目标信息,解决了航拍图像中车辆较小、拥挤等问题,同时提高了检测效率. ...

AVDNet: A small-sized vehicle detection network for aerial visual data

1

2020

... 航空影像中的车辆具有多尺度、多旋转角度和场景复杂等特点,这使得车辆的检测定位更具挑战性.Deng等[73]构建了一种基于超特征映射的目标定位框架AVPN,可以有效地提取小目标特征,实时准确生成车辆建议区,此外还设计了车辆属性学习网络来提取车辆位置.Yang等[74]在Faster R-CNN基础上,构建了一种多视角卷积神经网络Multi-PerNet用于车辆目标检测,通过使用不同尺寸的卷积核提取具有不同感受野的特征图,解决了因缺少目标特征而导致车辆目标检测精度低的问题.Mandal等[75]构建了一种多尺度残差块结构,以获得低层更详细的目标信息,解决了航拍图像中车辆较小、拥挤等问题,同时提高了检测效率. ...

Vehicle detection from high-resolution remote sensing imagery using convolutional capsule networks

1

2019

... 为实现车辆目标检测中任意方向建议框的预测,Tang等[31]提出了一种导向型的车辆目标检测网络Oriented_SSD,通过产生具有方向性的包围框以更准确地提取不同旋转方向的车辆.Yu等[76]通过对图像进行超像素分割来生成具有意义的斑块,将其输入到卷积胶囊网络中以有效检测不同尺度、方向和遮挡水平的车辆. ...

Airport detection using end-to-end convolutional neural network with hard example mining

1

2017

... 针对机场目标检测存在的难题,部分研究者设计了硬样本挖掘结构,通过加入负样本训练以增强模型的学习能力[77-78],亦或通过优化RPN结构,产生质量更高的建议区以提高检测精度[79-80].此外,还可以通过引入先验知识,剔除非地面区域,对道路进行分割以及设置面积及长度阈值来约束机场候选区域[81];Li等[82]提出了一种联合连续学习下的残差块网络模型,结合连续学习构建包含多尺度、多视角的复杂背景条件下的机场数据集,利用差异值法生成锚点,利用连续学习对网络进行权重更新,从而准确、快速地从海量复杂背景下的光学遥感影像中识别出机场. ...

Airport detection based on a multiscale fusion feature for optical remote sensing images

1

2017

... 针对机场目标检测存在的难题,部分研究者设计了硬样本挖掘结构,通过加入负样本训练以增强模型的学习能力[77-78],亦或通过优化RPN结构,产生质量更高的建议区以提高检测精度[79-80].此外,还可以通过引入先验知识,剔除非地面区域,对道路进行分割以及设置面积及长度阈值来约束机场候选区域[81];Li等[82]提出了一种联合连续学习下的残差块网络模型,结合连续学习构建包含多尺度、多视角的复杂背景条件下的机场数据集,利用差异值法生成锚点,利用连续学习对网络进行权重更新,从而准确、快速地从海量复杂背景下的光学遥感影像中识别出机场. ...

End-to-end airport detection in remote sensing images combining cascade region proposal networks and multi-threshold detection networks

1

2018

... 针对机场目标检测存在的难题,部分研究者设计了硬样本挖掘结构,通过加入负样本训练以增强模型的学习能力[77-78],亦或通过优化RPN结构,产生质量更高的建议区以提高检测精度[79-80].此外,还可以通过引入先验知识,剔除非地面区域,对道路进行分割以及设置面积及长度阈值来约束机场候选区域[81];Li等[82]提出了一种联合连续学习下的残差块网络模型,结合连续学习构建包含多尺度、多视角的复杂背景条件下的机场数据集,利用差异值法生成锚点,利用连续学习对网络进行权重更新,从而准确、快速地从海量复杂背景下的光学遥感影像中识别出机场. ...

Remote sensing airport detection based on end-to-end deep transferable convolutional neural networks

1

2019

... 针对机场目标检测存在的难题,部分研究者设计了硬样本挖掘结构,通过加入负样本训练以增强模型的学习能力[77-78],亦或通过优化RPN结构,产生质量更高的建议区以提高检测精度[79-80].此外,还可以通过引入先验知识,剔除非地面区域,对道路进行分割以及设置面积及长度阈值来约束机场候选区域[81];Li等[82]提出了一种联合连续学习下的残差块网络模型,结合连续学习构建包含多尺度、多视角的复杂背景条件下的机场数据集,利用差异值法生成锚点,利用连续学习对网络进行权重更新,从而准确、快速地从海量复杂背景下的光学遥感影像中识别出机场. ...

A hierarchical airport detection method using spatial analysis and deep learning

1

2019

... 针对机场目标检测存在的难题,部分研究者设计了硬样本挖掘结构,通过加入负样本训练以增强模型的学习能力[77-78],亦或通过优化RPN结构,产生质量更高的建议区以提高检测精度[79-80].此外,还可以通过引入先验知识,剔除非地面区域,对道路进行分割以及设置面积及长度阈值来约束机场候选区域[81];Li等[82]提出了一种联合连续学习下的残差块网络模型,结合连续学习构建包含多尺度、多视角的复杂背景条件下的机场数据集,利用差异值法生成锚点,利用连续学习对网络进行权重更新,从而准确、快速地从海量复杂背景下的光学遥感影像中识别出机场. ...

联合连续学习下的残差网络遥感影像机场目标检测 方法

1

2020

... 针对机场目标检测存在的难题,部分研究者设计了硬样本挖掘结构,通过加入负样本训练以增强模型的学习能力[77-78],亦或通过优化RPN结构,产生质量更高的建议区以提高检测精度[79-80].此外,还可以通过引入先验知识,剔除非地面区域,对道路进行分割以及设置面积及长度阈值来约束机场候选区域[81];Li等[82]提出了一种联合连续学习下的残差块网络模型,结合连续学习构建包含多尺度、多视角的复杂背景条件下的机场数据集,利用差异值法生成锚点,利用连续学习对网络进行权重更新,从而准确、快速地从海量复杂背景下的光学遥感影像中识别出机场. ...

联合连续学习下的残差网络遥感影像机场目标检测 方法

1

2020

... 针对机场目标检测存在的难题,部分研究者设计了硬样本挖掘结构,通过加入负样本训练以增强模型的学习能力[77-78],亦或通过优化RPN结构,产生质量更高的建议区以提高检测精度[79-80].此外,还可以通过引入先验知识,剔除非地面区域,对道路进行分割以及设置面积及长度阈值来约束机场候选区域[81];Li等[82]提出了一种联合连续学习下的残差块网络模型,结合连续学习构建包含多尺度、多视角的复杂背景条件下的机场数据集,利用差异值法生成锚点,利用连续学习对网络进行权重更新,从而准确、快速地从海量复杂背景下的光学遥感影像中识别出机场. ...

Effective building extraction from high-resolution remote sensing images with multitask driven deep neural network

1

2019

... 城市建筑物信息提取已在数字城市、城市规划、城市灾害等研究领域得到了广泛的应用.通过CNN或者语义分割模型进行特征提取[83-84],可以实现建筑物的快速检测. ...

Detection of collapsed buildings in post-earthquake remote sensing images based on the improved YOLOv3

1

2020

... 城市建筑物信息提取已在数字城市、城市规划、城市灾害等研究领域得到了广泛的应用.通过CNN或者语义分割模型进行特征提取[83-84],可以实现建筑物的快速检测. ...

Target classification using the deep convolutional networks for SAR images

1

2016

... 海冰是高维度地区海水冻结形成的冰,是影响全球气候变化的重要地理现象.目前使用深度学习进行海冰目标检测的研究相对较少,主要利用CNN对遥感图像中海冰进行特征提取,以实现海冰分类[85-86].溢油一般指因人类活动等因素而造成石油在海洋运输中产生了泄露.溢油目标检测在渔业、海洋环境保护等方面具有重要意义.相比于传统检测方法,基于深度学习模型的溢油目标检测成本较低,效率更高[87-88].水体富营养化会导致藻类大量繁殖,形成水华,这给生态环境和社会经济都带来一定负担.利用深度学习方法可以实现对水华的快速检测及预测[89],在生态治理、环境保护等方面有重要作用. ...

Combining 3D-CNN and squeeze-and-excitation networks for remote sensing sea ice image classification

1

2020

... 海冰是高维度地区海水冻结形成的冰,是影响全球气候变化的重要地理现象.目前使用深度学习进行海冰目标检测的研究相对较少,主要利用CNN对遥感图像中海冰进行特征提取,以实现海冰分类[85-86].溢油一般指因人类活动等因素而造成石油在海洋运输中产生了泄露.溢油目标检测在渔业、海洋环境保护等方面具有重要意义.相比于传统检测方法,基于深度学习模型的溢油目标检测成本较低,效率更高[87-88].水体富营养化会导致藻类大量繁殖,形成水华,这给生态环境和社会经济都带来一定负担.利用深度学习方法可以实现对水华的快速检测及预测[89],在生态治理、环境保护等方面有重要作用. ...

Two-stage convolutional neural network for ship and spill detection using SLAR images

1

2018

... 海冰是高维度地区海水冻结形成的冰,是影响全球气候变化的重要地理现象.目前使用深度学习进行海冰目标检测的研究相对较少,主要利用CNN对遥感图像中海冰进行特征提取,以实现海冰分类[85-86].溢油一般指因人类活动等因素而造成石油在海洋运输中产生了泄露.溢油目标检测在渔业、海洋环境保护等方面具有重要意义.相比于传统检测方法,基于深度学习模型的溢油目标检测成本较低,效率更高[87-88].水体富营养化会导致藻类大量繁殖,形成水华,这给生态环境和社会经济都带来一定负担.利用深度学习方法可以实现对水华的快速检测及预测[89],在生态治理、环境保护等方面有重要作用. ...

A deep Convolutional Neural Network for oil spill detection from spaceborne SAR images

1

2020

... 海冰是高维度地区海水冻结形成的冰,是影响全球气候变化的重要地理现象.目前使用深度学习进行海冰目标检测的研究相对较少,主要利用CNN对遥感图像中海冰进行特征提取,以实现海冰分类[85-86].溢油一般指因人类活动等因素而造成石油在海洋运输中产生了泄露.溢油目标检测在渔业、海洋环境保护等方面具有重要意义.相比于传统检测方法,基于深度学习模型的溢油目标检测成本较低,效率更高[87-88].水体富营养化会导致藻类大量繁殖,形成水华,这给生态环境和社会经济都带来一定负担.利用深度学习方法可以实现对水华的快速检测及预测[89],在生态治理、环境保护等方面有重要作用. ...

HABNet: Machine learning, remote sensing-based detection of harmful algal blooms

1

2020

... 海冰是高维度地区海水冻结形成的冰,是影响全球气候变化的重要地理现象.目前使用深度学习进行海冰目标检测的研究相对较少,主要利用CNN对遥感图像中海冰进行特征提取,以实现海冰分类[85-86].溢油一般指因人类活动等因素而造成石油在海洋运输中产生了泄露.溢油目标检测在渔业、海洋环境保护等方面具有重要意义.相比于传统检测方法,基于深度学习模型的溢油目标检测成本较低,效率更高[87-88].水体富营养化会导致藻类大量繁殖,形成水华,这给生态环境和社会经济都带来一定负担.利用深度学习方法可以实现对水华的快速检测及预测[89],在生态治理、环境保护等方面有重要作用. ...

Multi-class geospatial object detection and geographic image classification based on collection of part detectors

1

2014

... NWPU VHR-10 dataset[90]是西北工业大学标注的航天遥感目标检测数据集,包含10类目标:飞机、棒球场、篮球场、桥梁、港口、田径场、船舶、油罐、网球场和车辆.该数据集包含了800张图像,有650张目标图像,150张背景图像,其中,包含715张空间分辨率为0.08~2 m 的RGB图像,85张分辨率为0.08 m的锐化彩色红外图像.NWPU VHR-10数据集是近年来使用率较高的高分辨率目标检测数据集. ...

Orientation robust object detection in aerial images using deep convolutional neural network

1

2015

... UCAS-AOD[91]是中国科学院大学模式识别实验室标注的数据集,2014年首次发布,包括飞机和汽车2类目标.其中包含600张飞机图像,共3 591个实例;310张汽车图像,共4 475个实例;492张反例图像.2015年,实验室对数据集进行补充,最终得到1 000张飞机图像,共7 482个实例;510张汽车图像,共7 114个实例;910张反例图像. ...

Elliptic fourier transformation-based histograms of oriented gradients for rotationally invariant object detection in remote-sensing images

1

2015

... RSOD[92]是武汉大学团队标注的谷歌地图和天地图遥感影像数据集,包含4类目标:飞机、操场、立交桥和油桶.其中包含有446张飞机图像,共4 993个实例;189张操场图像,共191个实例;176张立交桥图像,共180个实例;165张油罐图像,共1 589个实例. ...

A high resolution optical satellite image dataset for ship recognition and some new baselines

1

... HRSC2016[93]是中科院自动化所是提出的船舶检测数据集,数据主要来源于谷歌地图上6个著名的港口.该数据集包含了1 061张图像,2 976个实例,其中,训练集,验证集和测试集占比约为2∶1∶2,图像尺寸最小为300×300,最大为1 500×900,图像分辨率为0.4~2 m.数据集中的船舶目标有旋转、缩放等多种变换,可以训练更具泛化能力的模型,是比较常用的船舶目标检测公开数据集. ...

Random access memories: A new paradigm for target detection in high resolution aerial remote sensing images

1

2018

... LEVIR[94]是北京航空航天大学史振威团队提出的高分辨率数据集,包含3类目标:飞机、轮船(包括近海和离岸轮船)和油罐.该数据集包含了来源于谷歌地图的22 000张图像,尺寸大小为800×600,其中,飞机4 724架,轮船3 025艘,油罐3 279个,图像分辨率为0.2~1 m. ...

DOTA: A large-scale dataset for object detection in aerial images

1

2018

... DOTA[95]是武汉大学遥感国家重点实验室夏桂松和华中科技大学电子信息与通信学院白翔联合提出的数据集,包含15类目标:飞机、船舶、储罐、棒球场、网球场、游泳池、田径场、港口、桥梁、大型车辆、小型车辆、直升机、环岛、足球场和篮球场.该数据集包含了2 806张航空影像,图像尺寸最小为800×800,最大为4 000×4 000,一共188 282个实例,标记方法采用不规则四边形.由于数据来自于不同的传感器,图像具有多种分辨率. ...

Ship detection in SAR images based on an improved faster R-CNN

1

2017

... SSDD[96]数据集是海军航空航天大学提出的第一个专门用于SAR图像船舶目标检测数据集,图像主要来源于RadarSat-2、TerraSAR-X和Sentinel-1传感器.该数据集包含1 160张图像,共2 456个船舶实例.训练集,验证集,测试集的占比为7∶2∶1,图像大小为500×500,分辨率为1~15 m.之后在SSDD基础上,还提出了SSDD+数据集,该数据集使用旋转包围框来标记船舶,以实现对目标的方向估计. ...

A SAR dataset of ship detection for deep learning under complex backgrounds

1

2019

... SAR-Ship[97]数据集是中国科学院空天信息创新研究院王超团队公开的船舶目标检测数据集,该数据集主要来源于高分三号和Sentinel-1SAR 图像,包含了43 819张船舶切片,其中,高分三号图像分辨率为3 m、5 m、8 m、25 m和10 m,分别对应UFS、FSI、QPSI、QPSII和FSII成像模式,Sentinel-1图像分辨率为1.7×4.3~3.6×4.9、20×22,分别对应S3条带图(SM)和IW成像模式.该数据集的船舶切片及船舶数目较多,无需进行数据增广就可以开展模型训练,且可以在无需海陆分割、无需区分成像模式的情况下实现快速船舶目标检测. ...

HRSID: A high-resolution SAR images dataset for ship detection and instance segmentation

1

2020

... HRSID[98]数据集是电子科技大学的苏浩团队于2020年发布的,用于船舶目标检测、语义分割和实例分割等任务,数据集来源于99张Sentinel-1 B卫星图像,36张TerraSAR-X图像和1张TanDEM-X图像.该数据集包含了5 604张SAR图像,共16 951个实例,图像大小为800×800,图像分辨率为0.5 m、1 m、3 m.该数据集使用了8个最先进的检测器对数据集进行检测和分割实验,并在大尺寸SAR图像上检验训练模型的迁移能力,最终得到近海船舶目标检测精度在41.3%~61.8%之间,离岸船舶目标检测精度在79.6%~87.1%之间,船舶分割精度在53.8%~55.4%之间.HRSID包含不同分辨率、极化、海况、海域和沿海港口的SAR图像,基于HRSID训练的模型可以在大尺度中进行船舶目标检测. ...

PCAN—part-based context attention network for thermal power plant detection in remote sensing imagery

1

2021

... (2)研究组合型目标检测.以往的遥感图像目标检测研究主要关注飞机、船舶、车辆等单目标,这些目标具有固定边界且与背景环境较易分离.然而,遥感图像中很多地物为多个目标的组合体,比如机场、火电厂、学校、垃圾处理厂等.组合型目标边界不固定,内部包含多个独立的、关系不确定的单个目标.因此,组合型目标的特征复杂多样,这就需要模型具有更强的特征表达能力,可以对场景语义进行更好地建模,有效区分前景和背景.目前,有研究[99-101]提出了针对组合目标的检测算法,但对于组合目标的研究仍不充分.如何对复杂场景中的组合目标进行更好的语义建模,实现大场景下的遥感图像组合目标检测,并通过检测结果挖掘组合目标对社会经济发展带来的潜在影响,是未来遥感图像解译的一个重要研究内容. ...

PBNet: Part-based convolutional neural network for complex composite object detection in remote sensing imagery

0

2021

Detection of schools in remote sensing images based on attention-guided dense network

1

2021